Helukabel blickt auf ein erfolgreiches Geschäftsjahr 2023 zurück: Mit knapp 1,1Mrd.€ erzielte der Systemanbieter für elektrische Verbindungstechnik den zweithöchsten Umsatz der Unternehmensgeschichte.

Bestellen Sie jetzt die Ausgabe 3 2024 des SPS-MAGAZINs. Und erfahren Sie alles zum Thema Automatisierungstechnik.

Die neue Delta GPS-Serie von Bicker Elektronik besteht aus drei Modellen mit Leistungen von 850W, 1000W und 1300W.

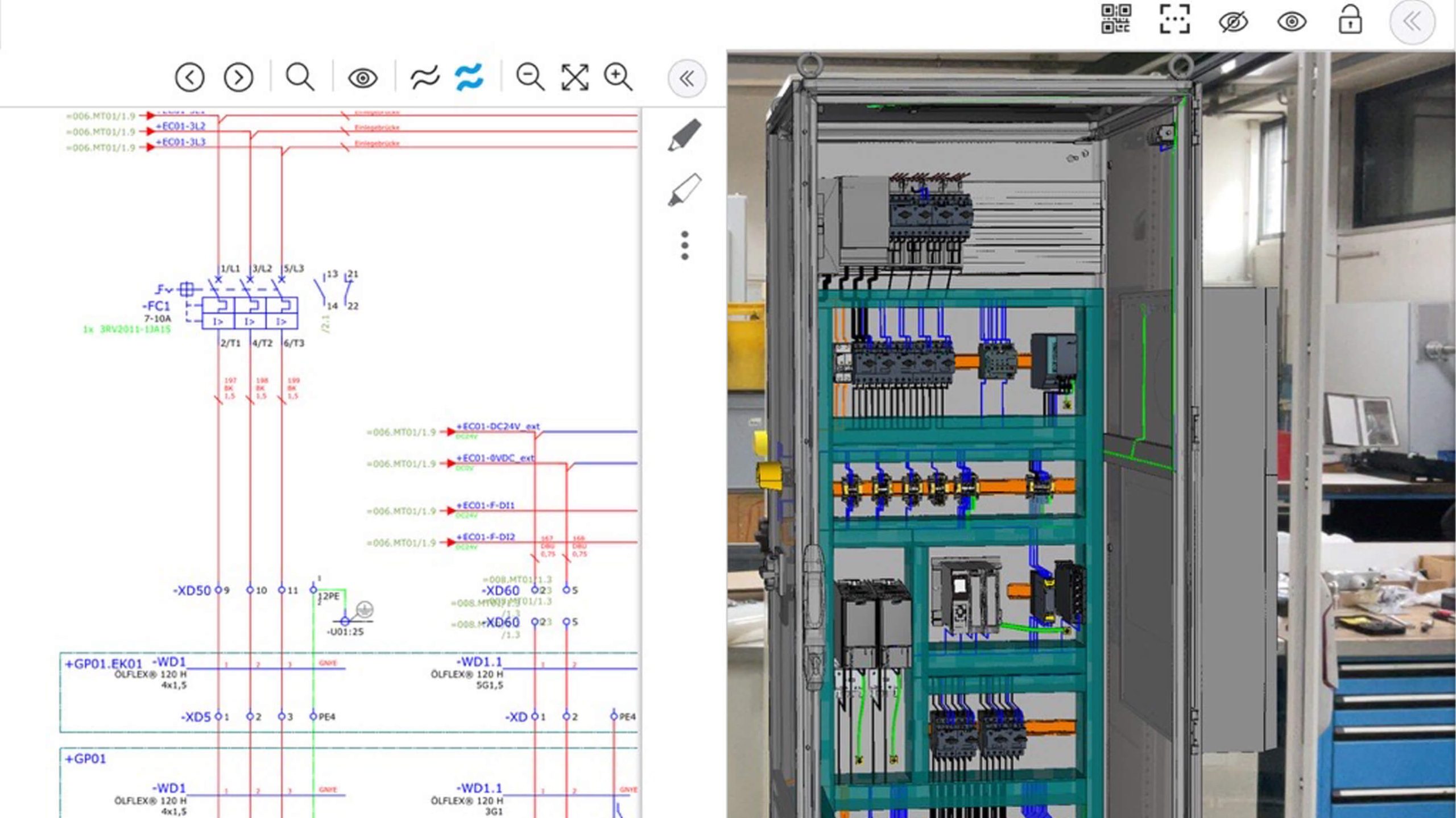

Eplan präsentiert in Hannover erste Einblicke in die erweiterte App eView AR.

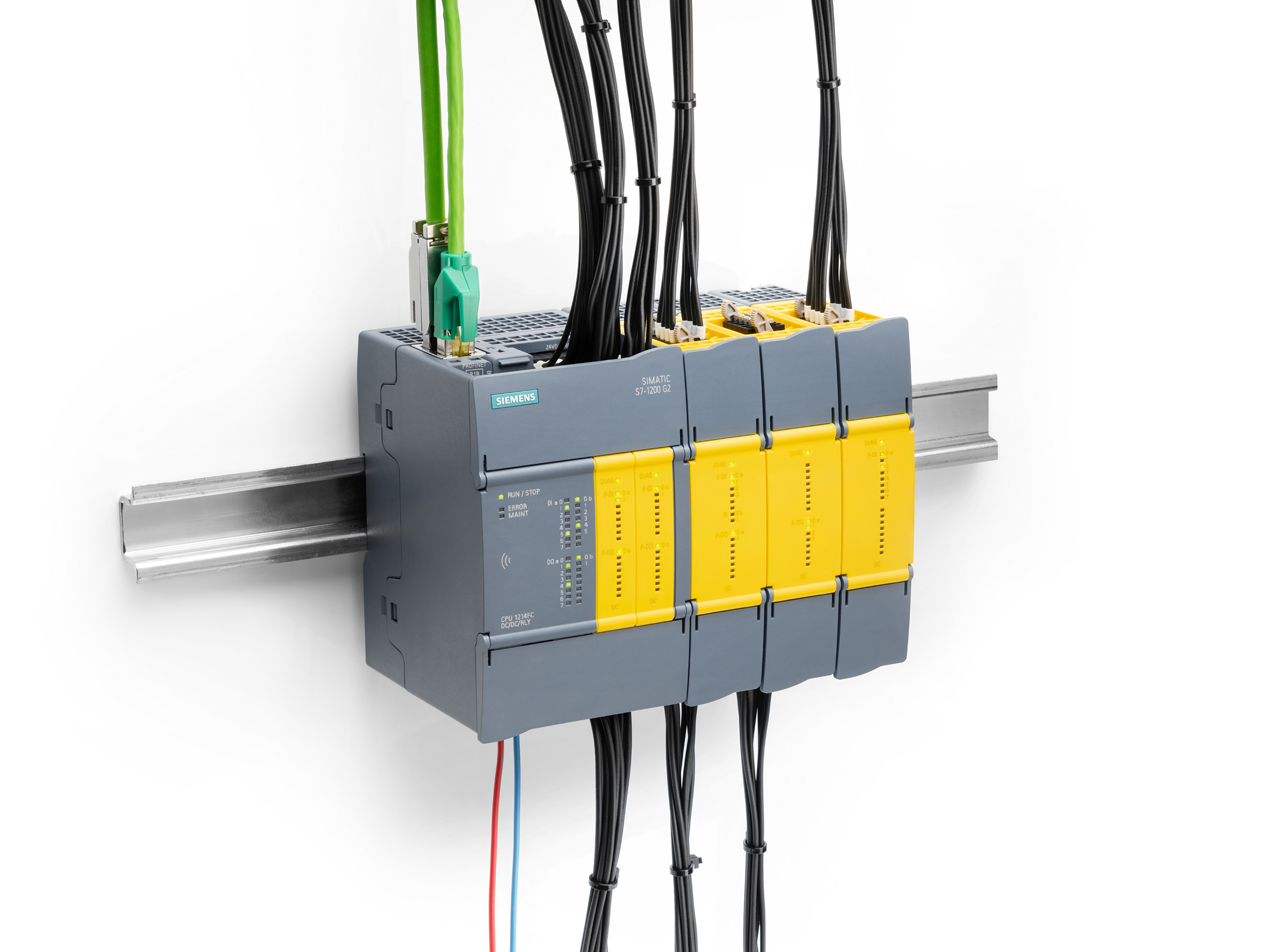

Siemens kündigt auf der Hannover Messe 2024 – zum ersten Mal seit zehn Jahren – eine neue Controller-Generation an, die ab Winter 2024 verfügbar sein wird.

Kraftsensoren von Megatron messen Schalt- und Betätigungskräfte über eine DMS-Vollbrücke mit hoher Genauigkeit.

EKF hat ein erstes ModBlox7-basiertes Produkt vorgestellt: Der robuste Single-Pair-Ethernet-Switch 7L600 verbindet Modularität mit hoher Rechenleistung und modernen Schnittstellen.

Der Klippon RailSnapper von Weidmüller ermöglicht es jetzt, die Tragschienenlänge voll auszuschöpfen.

Lapp hat seinem Epic-Rechtecksteckverbinder-Gehäuse ein Re-Design verpasst.

Das Ident Gate System (IGS) von Sick soll mit Sensoren zur Objekterfassung, Warenidentifikation und Richtungserkennung für mehr Transparenz im Warenein- und -ausgang sorgen.

Bota Systems stellt mit dem Modell T5 eine hochsensible Version seines Kraft/Momenten-Sensors SensOne vor.

Die neuen induktiven Ringsensoren der IRSD-Serie von Di-soric erkennen kleine Metallteile zuverlässig.

Simatic ET 200clean von Siemens wurde entwickelt, um Hygiene-Herausforderungen entgegenzuwirken und Produktionsprozesse zu verbessern.

Siemens präsentiert mit Xcelerator for Digital Drivetrain ein Angebot an IoT-fähiger Hard- und Software für den gesamten Antriebsstrang.

Das IoT-Tool IoT SiteWise Edge von AWS ist nun auf dem Industrial-Edge-Marktplatz verfügbar.

Der cloudbasierte Sinec Security Guard von Siemens bietet ein automatisiertes Schwachstellen-Mapping und Sicherheitsmanagement, das für industrielle Betreiber in OT-Umgebungen konzipiert ist.

Onlogic hat seine neuen Rugged-Panel-PCs und Industrie-Touchscreen-Displays der Tacton-Serie vorgestellt.

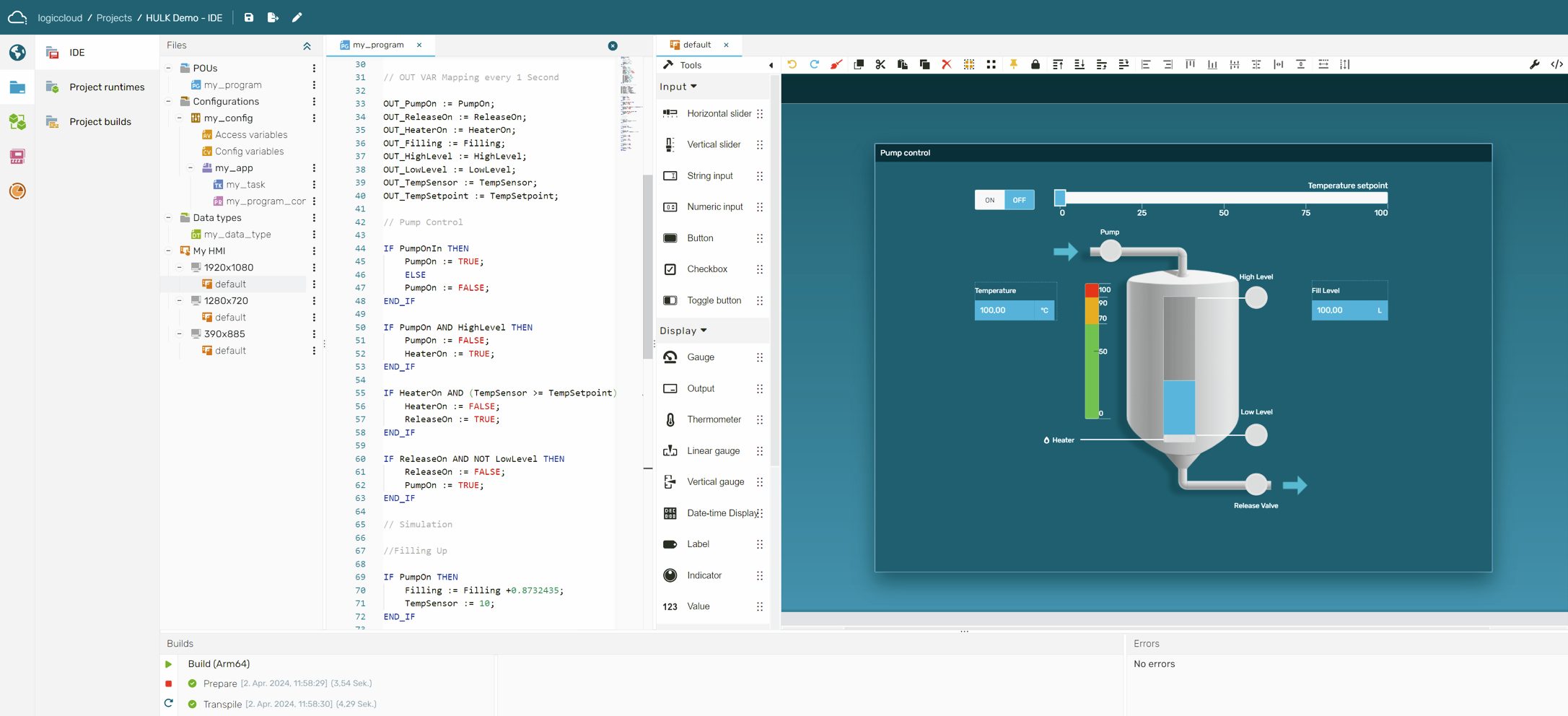

Ab sofort ist Logiccloud Teil der CtrIX World, dem offenen Ökosystem rund um die CtrIX Automation Plattform von Bosch Rexroth.

Mit Sigreen Connect von Siemens sollen Unternehmen eigene Emissionen auf Produktebene künftig automatisiert berechnen und an die Product-Carbon-Footprint-Management-Lösung Sigreen übermitteln.

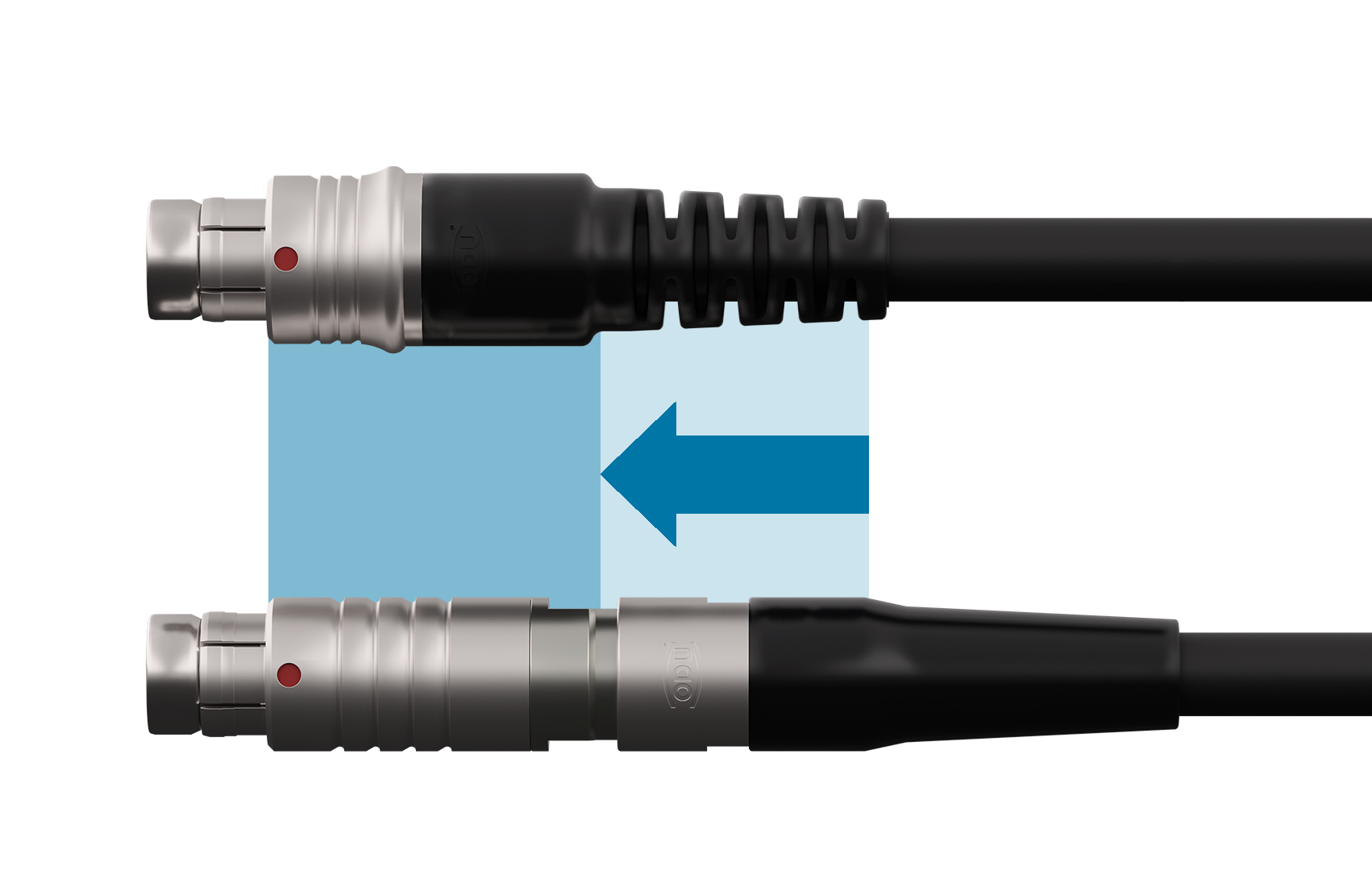

Der Odu Mini-Snap Serie F Super Shorty Steckverbinder bietet mit seiner um 25 Prozent reduzierten Bauform eine Lösung für Anwendungen, die einen leichten Einbau in extrem beengten Räumen erfordern.

Mit der App Industrial News Arena erfahren Sie wichtige Nachrichten aus Ihrer Branche sofort. Lesen Sie zu jeder Zeit, welche Branchen-Themen die Community aus Ihrem Interessengebiet bewegen. In wenigen Augenblicken gewinnen Sie Tag für Tag schnell den Überblick über alle relevanten Ereignisse aus der Automatisierung, industriellen Bildverarbeitung, Gebäudetechnik, industriellen IT, Robotik und Schaltschrankbau. Die einfache Navigation macht das Lesen von Nachrichten zu einem neuen Erlebnis.

Die kostenlose App können Sie hier downloaden:

http://app.industrialnewsarena.de

Time-Sensitive Networking – ZEIT ZUM HANDELN! 2020 ist das 20. Jubiläum der CC-Link Partner Association. Erfahren Sie, wie CC-Link IE TSN Ihr Unternehmen untestützen kann, sich auf die Automatisierungsaufgaben der nächsten 20 Jahre vorzubereiten.

Wir stellen uns diesen Herausforderungen, denn wir sind gut gerüstet. Neben qualitativ hochwertigen Produkten, die das ganze Spektrum von Low- und Middle- bis High- End-Automatisierungsprodukten und -Lösungen abdecken, sind unsere Spezialisten visionär und arbeiten in einem weltumspannenden Netzwerk aus Niederlassungen, Servicestationen, Systempartnern und Entwicklern.