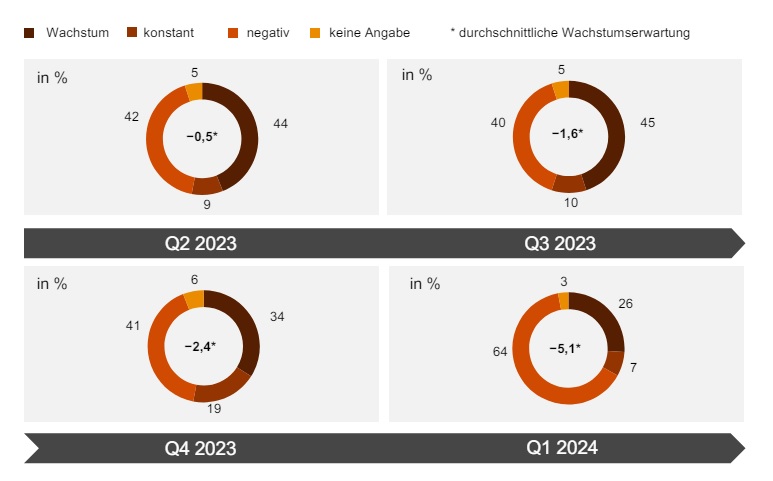

Besorgt blicken die Entscheidungsträger im Maschinen- und Anlagenbau auf die konjunkturelle Entwicklung in Deutschland.

Bestellen Sie jetzt die Ausgabe 3 2024 des SPS-MAGAZINs. Und erfahren Sie alles zum Thema Automatisierungstechnik.

Mit zwei Industrierechnern, der kompakten Prime Box Picosowie dem Panel-PC Prime Panel Pico 15,6″ unterstützt Schubert System Elektronik (SSE) die Automatisierungsmarktplatz von Flecs, der auf die einfachen Installation von App auf Maschinensteuerungen abzielt.

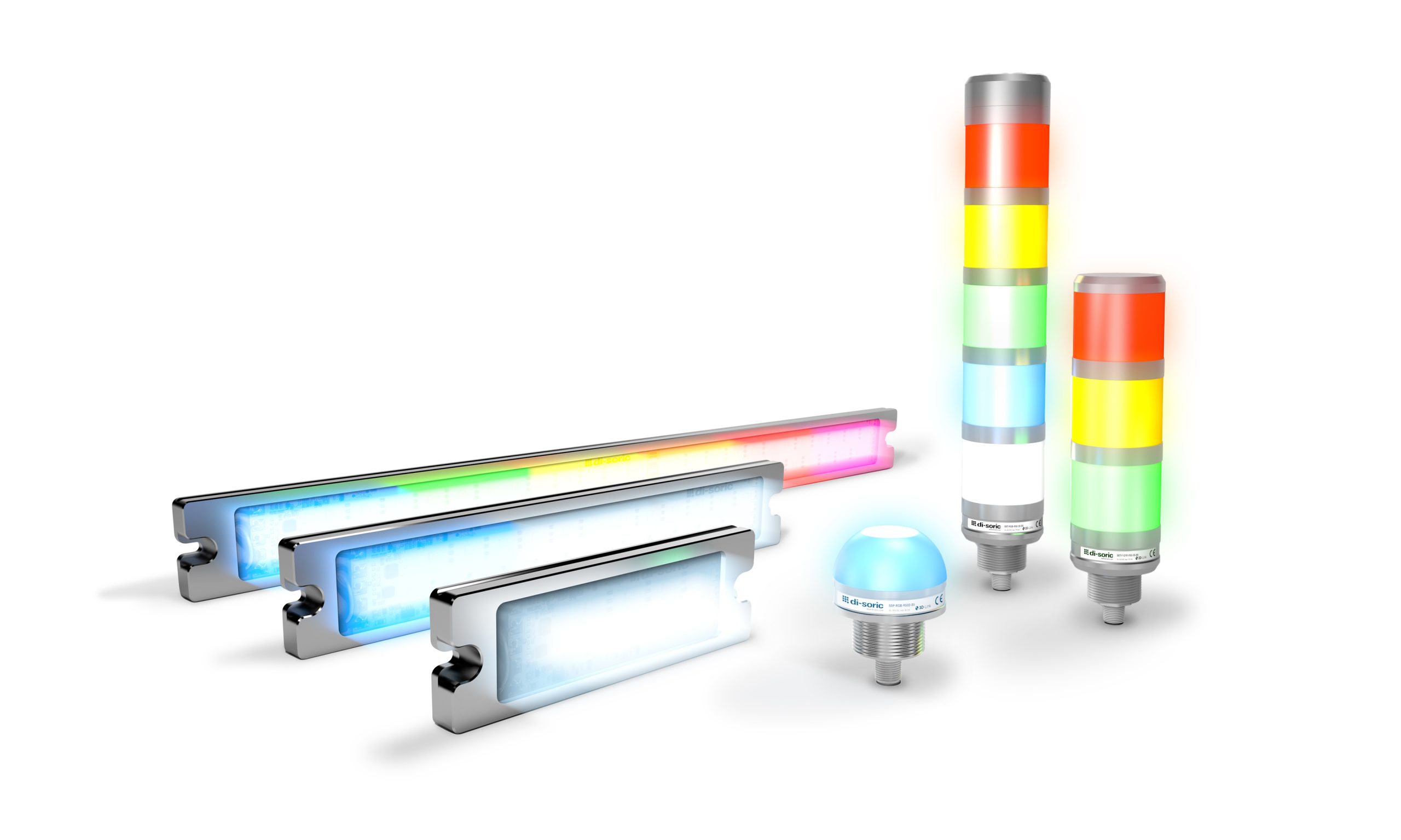

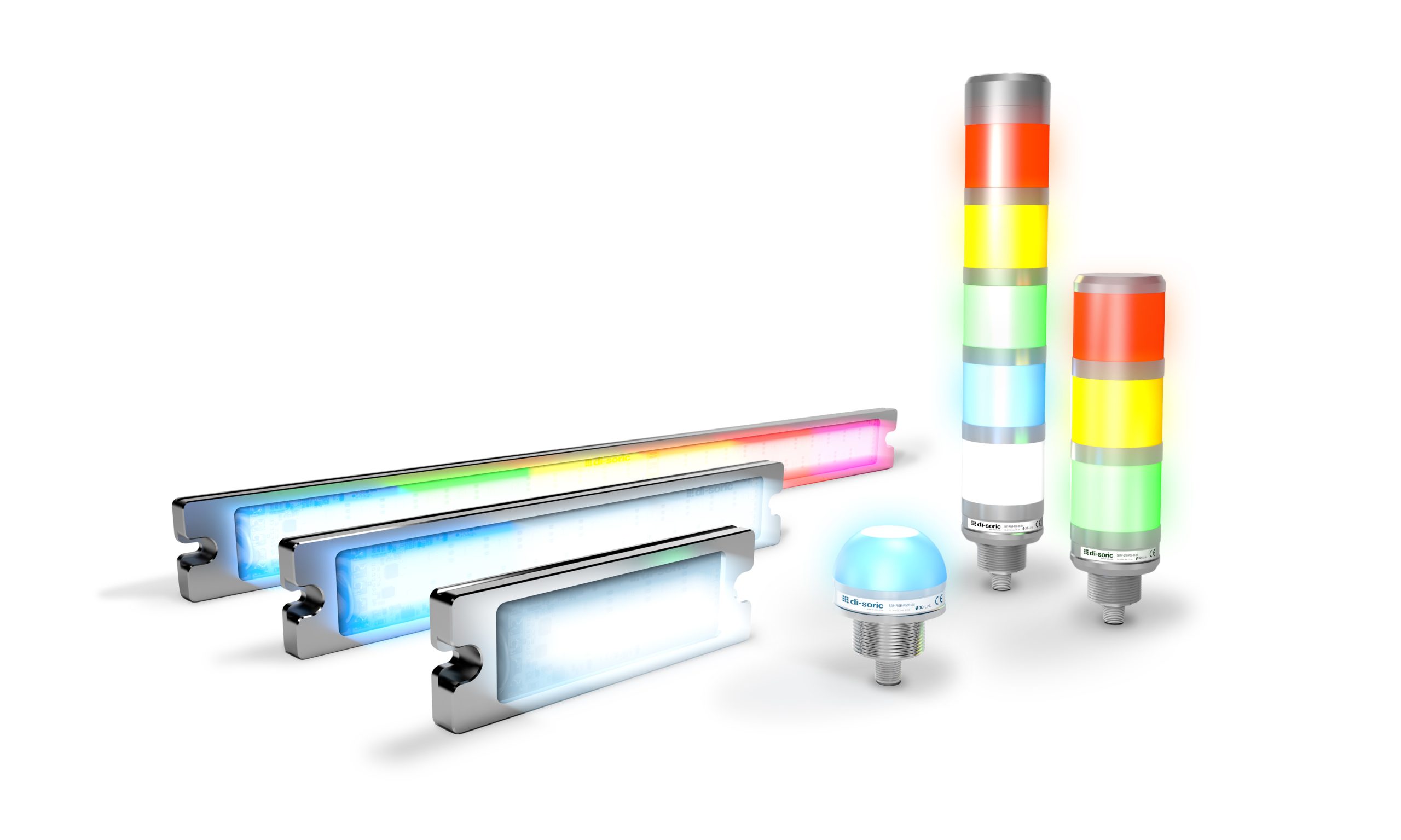

Die Multisegment-Signalsäule der Serie SBT-RGB eignet sich ebenso wie die kompakte domförmige multifunktionale Signalbeleuchtung der Serie SBP-RGB von Disoric zur Darstellung und Übermittlung unterschiedlichster Anlagenzustände. Ohne einzelne Leuchtsegmente stecken zu müssen, weisen Anwender per Software über die IO-Link Prozessdaten jedem Segment einfach die gewünschte Farbe, Helligkeit sowie das Blinkverhalten zu.

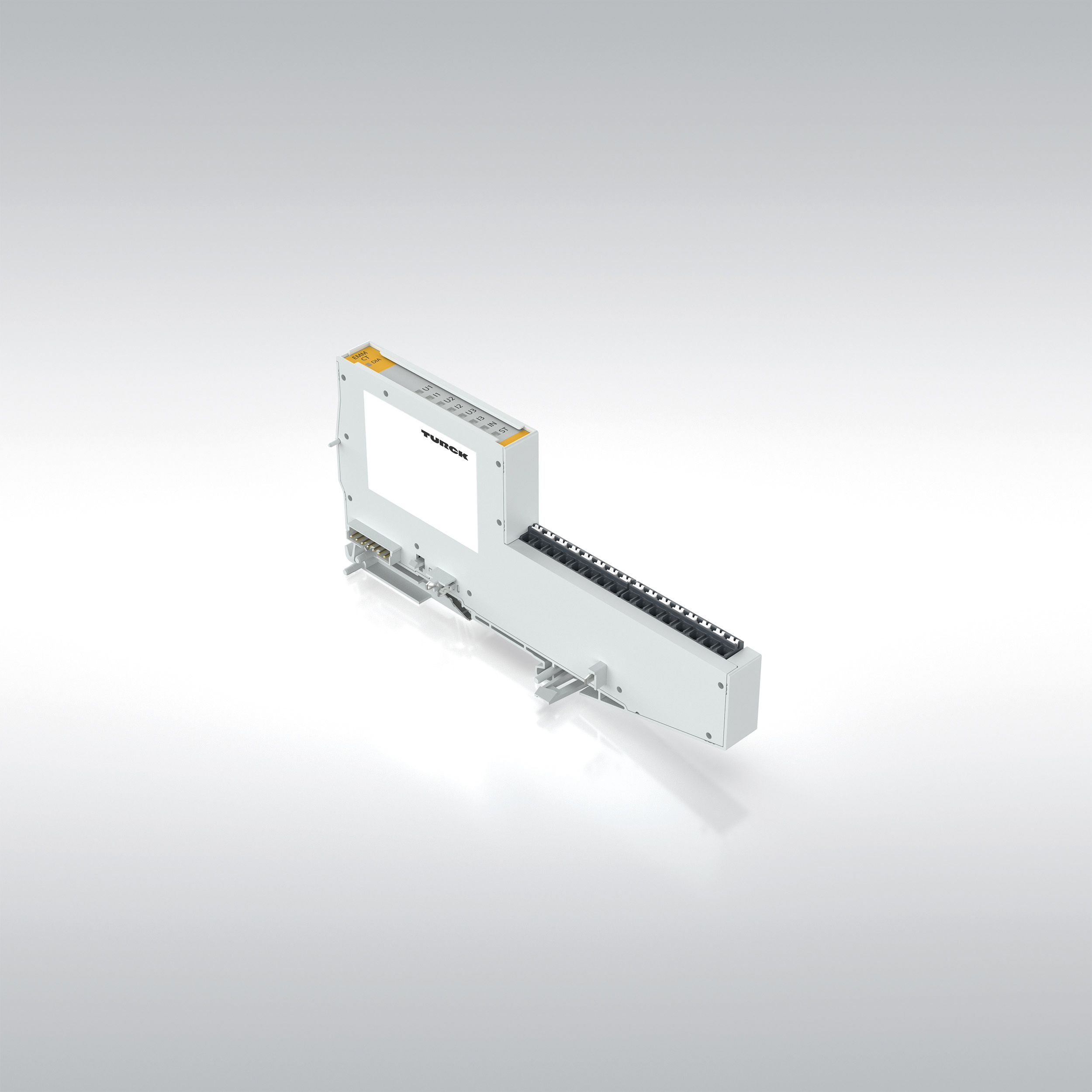

Turck erweitert sein I/O-System BL20 um 3-Phasen-Energiemessmodule für 1-A- und 5-A-Stromwandler zu einer umfassenden Energiemanagementlösung.

Die Multisegment-Signalsäule der Serie SBT-RGB eignet sich ebenso wie die kompakte domförmige multifunktionale Signalbeleuchtung der Serie SBP-RGB von Disoric zur Darstellung und Übermittlung unterschiedlichster Anlagenzustände. Ohne einzelne Leuchtsegmente stecken zu müssen, weisen Anwender per Software über die IO-Link Prozessdaten jedem Segment einfach die gewünschte Farbe, Helligkeit sowie das Blinkverhalten zu.

Softing Industrial präsentiert sein neues EdgeGate – eine wartungsfreie Hardware-Lösung für die Übertragung von Produktionsdaten aus SPS- und CNC-Steuerungen in Edge- und Cloud-basierte Umgebungen.

Die Industrial Firewalls der 1000er und 3000er Serie von ADS-Tec Industrial IT bieten eine umfassende Sicherheitslösung zur Vernetzung, Steuerung und Absicherung von verketteten Maschinen und Anlagen.

EAO erweitert seine Baureihe der 09 In-Cabin Produktfamilie – mit dem Rotary Cursor Controller und Rotary Pushbutton für intuitives Drehen, Drücken und Neigen im Fahrzeuginnenbereich.

Schaltbau präsentiert seine neue Produktreihe Smart Circuit Breaker.

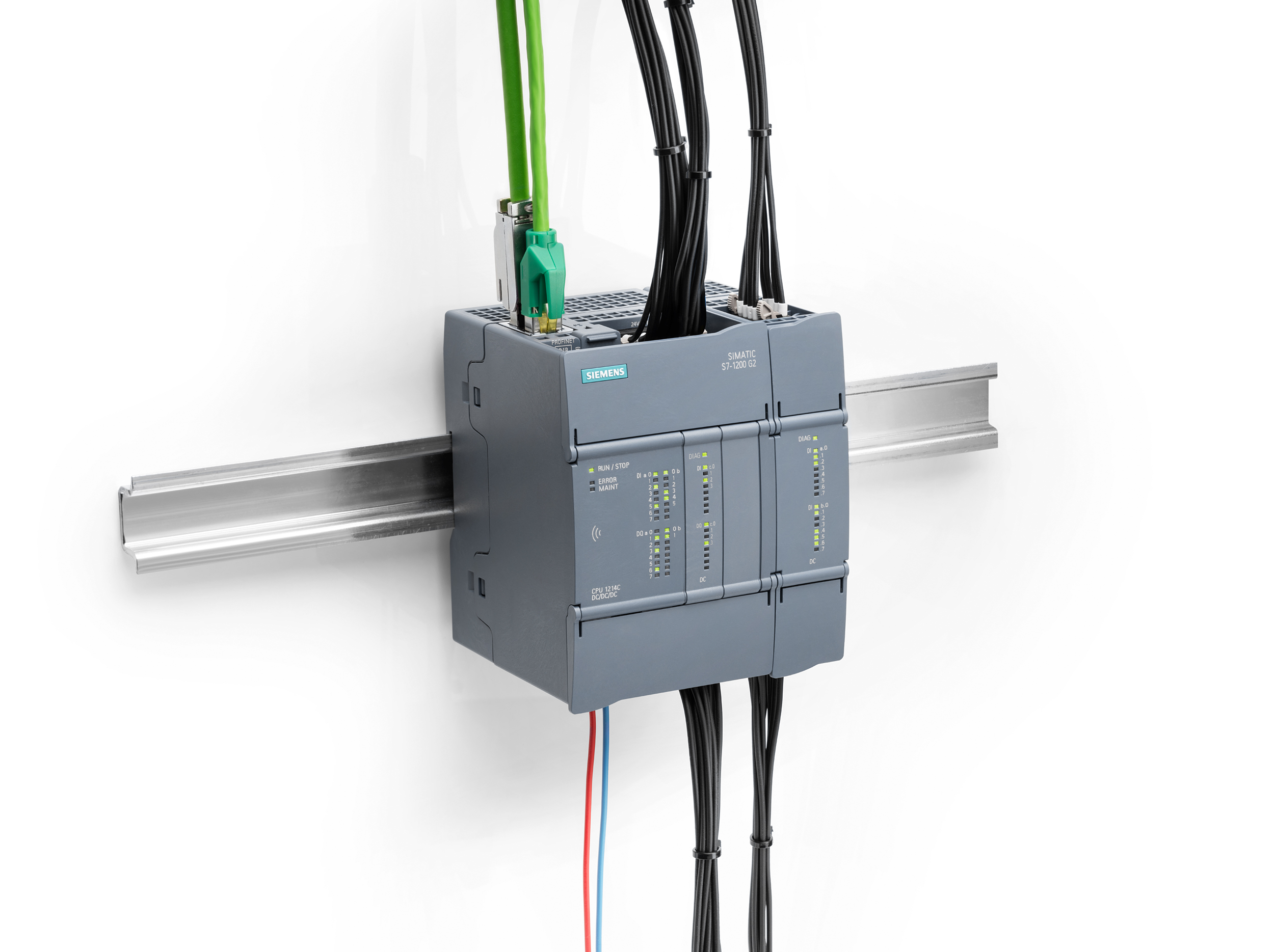

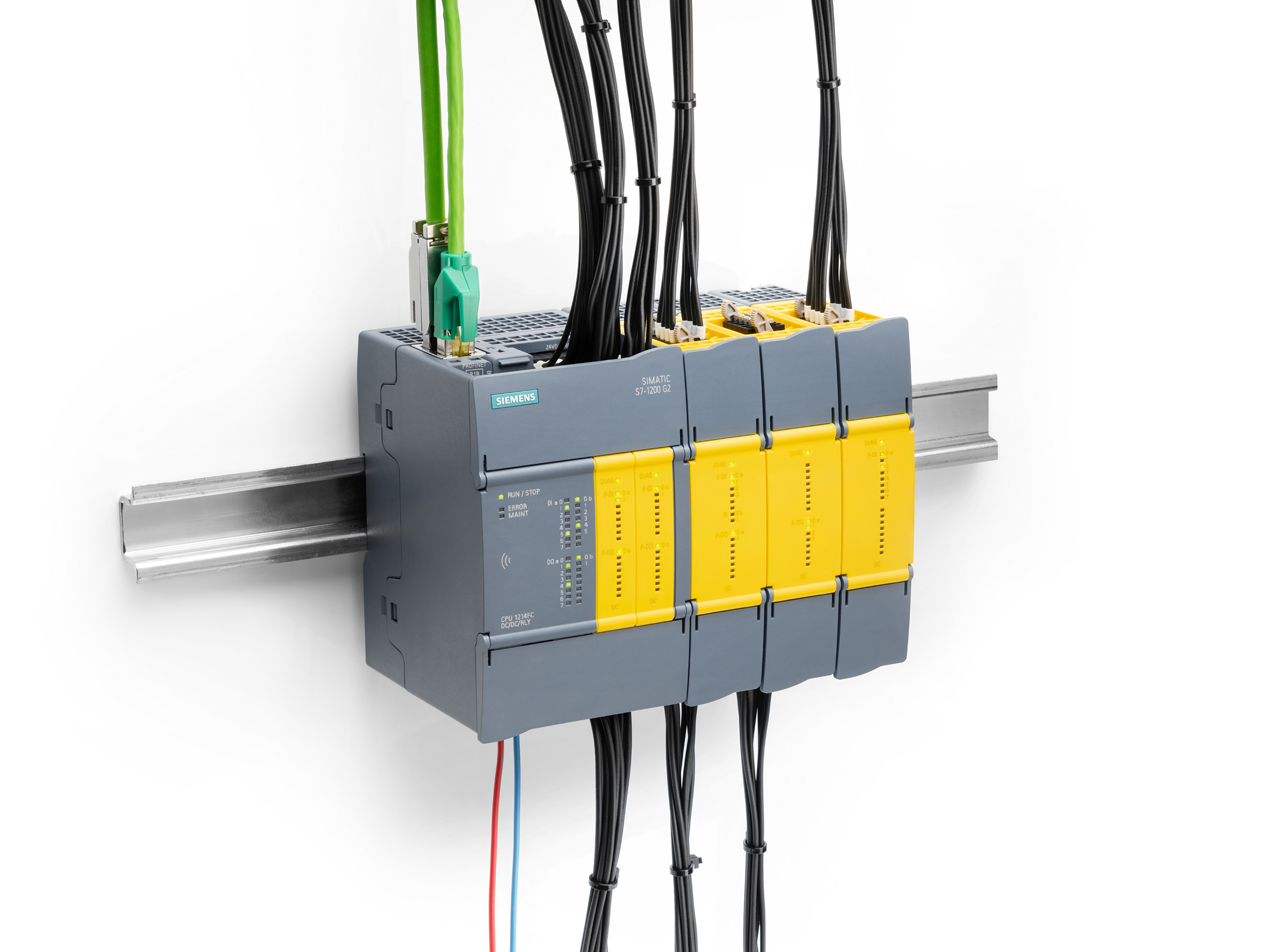

Die neuen Simatic-S7-1200-G2-Controller von sind auf die Kombination von Motion-Control-Funktionen mit flexiblen Maschinen-Sicherheitslösungen ausgelegt.

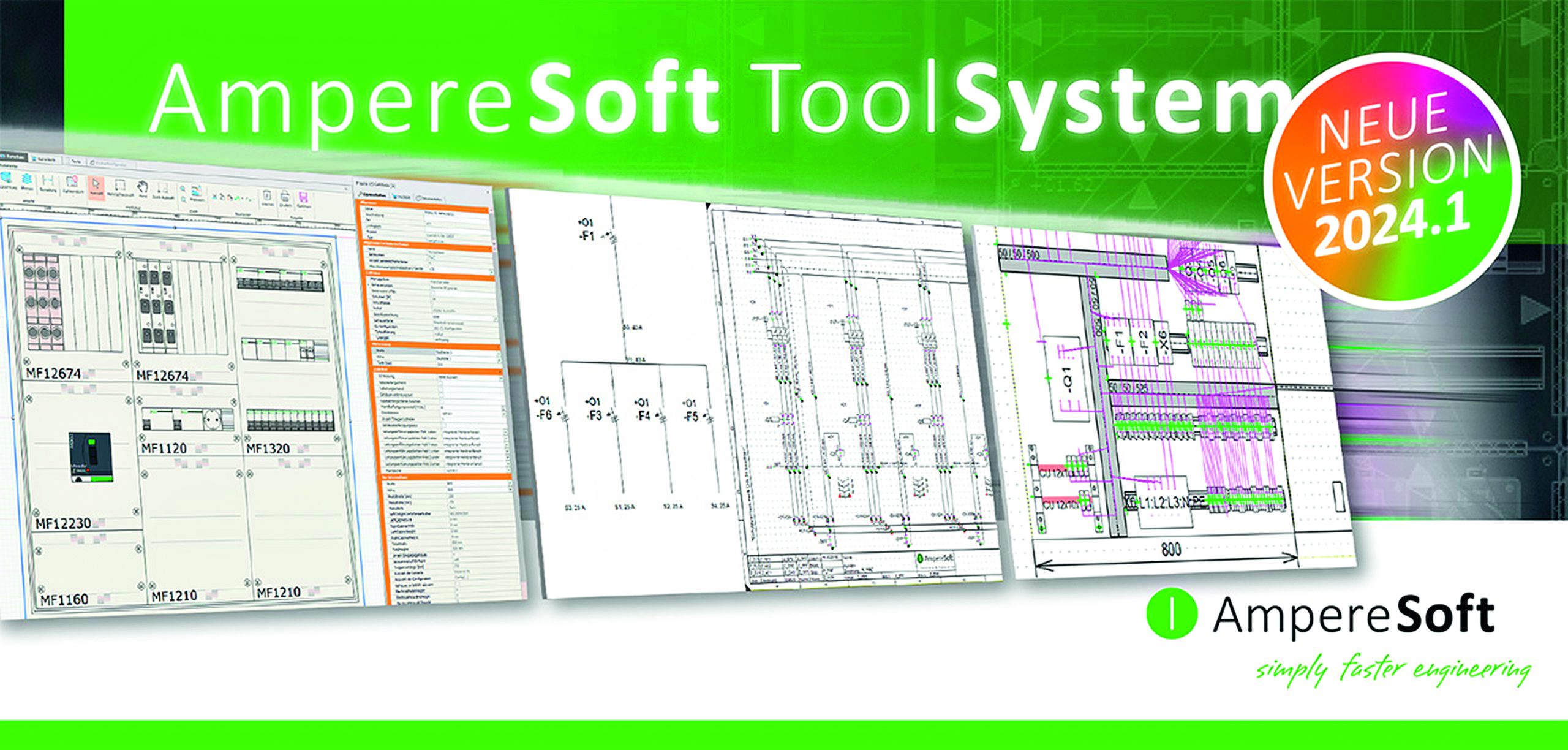

Modernisierte Icons, neue Klasse für Steckverbinder, vereinfachte Materialkombinationen: Die Version 2024.1 des AmpereSoft ToolSystems bietet zahlreiche Funktionserweiterungen, die für ein einfacheres, intuitiveres und schnelleres Engineering sorgen.

Die neue Delta GPS-Serie von Bicker Elektronik besteht aus drei Modellen mit Leistungen von 850W, 1000W und 1300W.

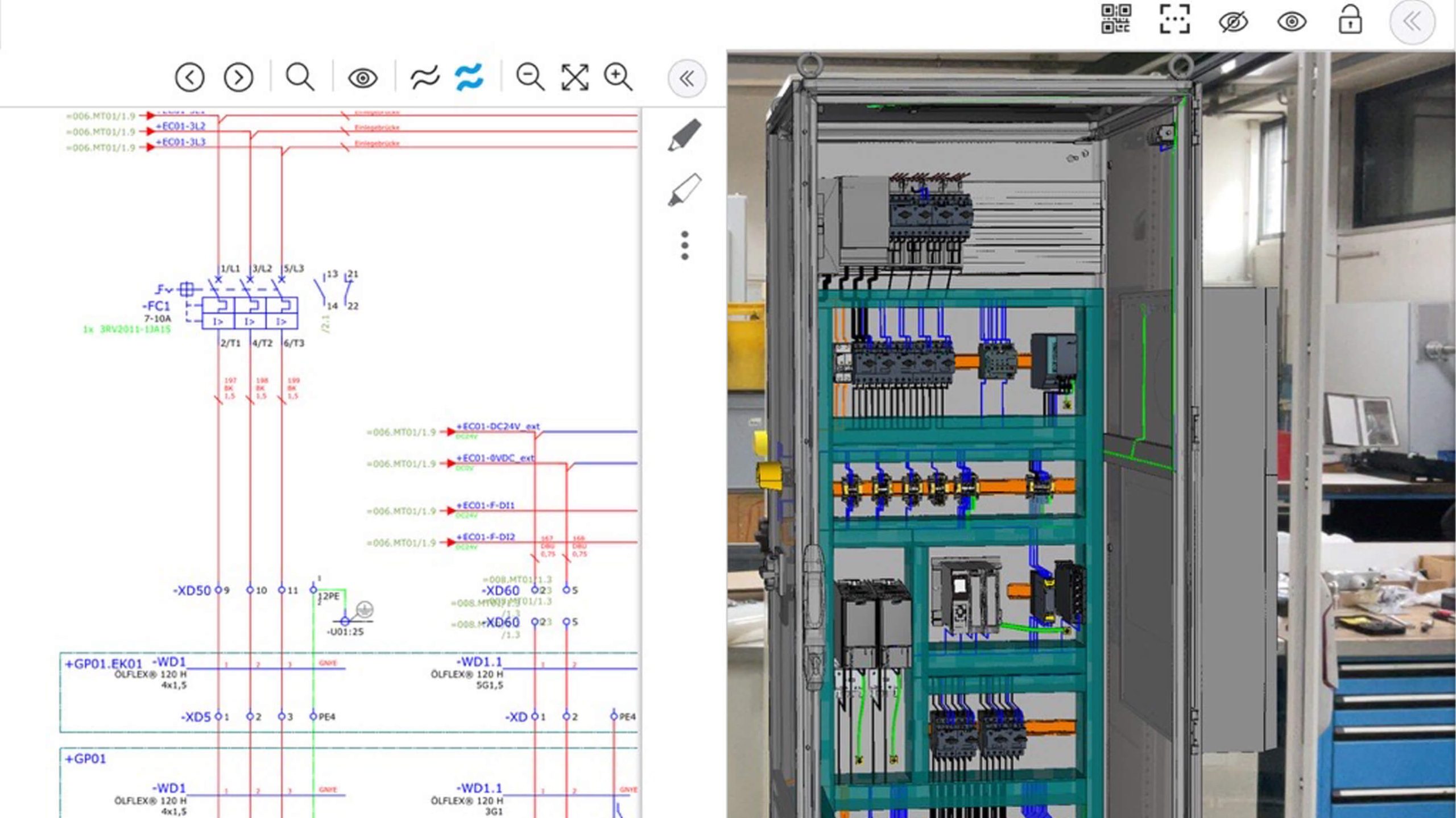

Eplan präsentiert in Hannover erste Einblicke in die erweiterte App eView AR.

Siemens kündigt auf der Hannover Messe 2024 – zum ersten Mal seit zehn Jahren – eine neue Controller-Generation an, die ab Winter 2024 verfügbar sein wird.

Kraftsensoren von Megatron messen Schalt- und Betätigungskräfte über eine DMS-Vollbrücke mit hoher Genauigkeit.

EKF hat ein erstes ModBlox7-basiertes Produkt vorgestellt: Der robuste Single-Pair-Ethernet-Switch 7L600 verbindet Modularität mit hoher Rechenleistung und modernen Schnittstellen.

Der Klippon RailSnapper von Weidmüller ermöglicht es jetzt, die Tragschienenlänge voll auszuschöpfen.

Lapp hat seinem Epic-Rechtecksteckverbinder-Gehäuse ein Re-Design verpasst.

Das Ident Gate System (IGS) von Sick soll mit Sensoren zur Objekterfassung, Warenidentifikation und Richtungserkennung für mehr Transparenz im Warenein- und -ausgang sorgen.

Mit der App Industrial News Arena erfahren Sie wichtige Nachrichten aus Ihrer Branche sofort. Lesen Sie zu jeder Zeit, welche Branchen-Themen die Community aus Ihrem Interessengebiet bewegen. In wenigen Augenblicken gewinnen Sie Tag für Tag schnell den Überblick über alle relevanten Ereignisse aus der Automatisierung, industriellen Bildverarbeitung, Gebäudetechnik, industriellen IT, Robotik und Schaltschrankbau. Die einfache Navigation macht das Lesen von Nachrichten zu einem neuen Erlebnis.

Die kostenlose App können Sie hier downloaden:

http://app.industrialnewsarena.de

Time-Sensitive Networking – ZEIT ZUM HANDELN! 2020 ist das 20. Jubiläum der CC-Link Partner Association. Erfahren Sie, wie CC-Link IE TSN Ihr Unternehmen untestützen kann, sich auf die Automatisierungsaufgaben der nächsten 20 Jahre vorzubereiten.

Wir stellen uns diesen Herausforderungen, denn wir sind gut gerüstet. Neben qualitativ hochwertigen Produkten, die das ganze Spektrum von Low- und Middle- bis High- End-Automatisierungsprodukten und -Lösungen abdecken, sind unsere Spezialisten visionär und arbeiten in einem weltumspannenden Netzwerk aus Niederlassungen, Servicestationen, Systempartnern und Entwicklern.