Die Sensoren sitzen auf einem präzisen Pan-Tilt-Gimbal aus ASA-Kunststoff, der Schwenkbewegungen von -60 bis 60° horizontal und -30 bis 90° vertikal erlaubt. Dank Power-over-Ethernet (PoE) sind Stromversorgung, Steuerung und Datenübertragung (Video-Signal) über ein einziges Kabel möglich.

Die Bildgebungskette der Sensorplattform nutzt drei komplementäre Prinzipien:

RGB-Kamera: Der verbaute Sony-IMX708-Sensor liefert hochauflösende Bilder (1280×720px bei 30fps). Er besitzt einen Horizontalsichtwinkel von 73,8° und eine Pixelgröße von 1,4µm. Für viele KI-Anwendungen lassen sich diese Bilder als Texturdaten oder zur Objekterkennung verwenden.

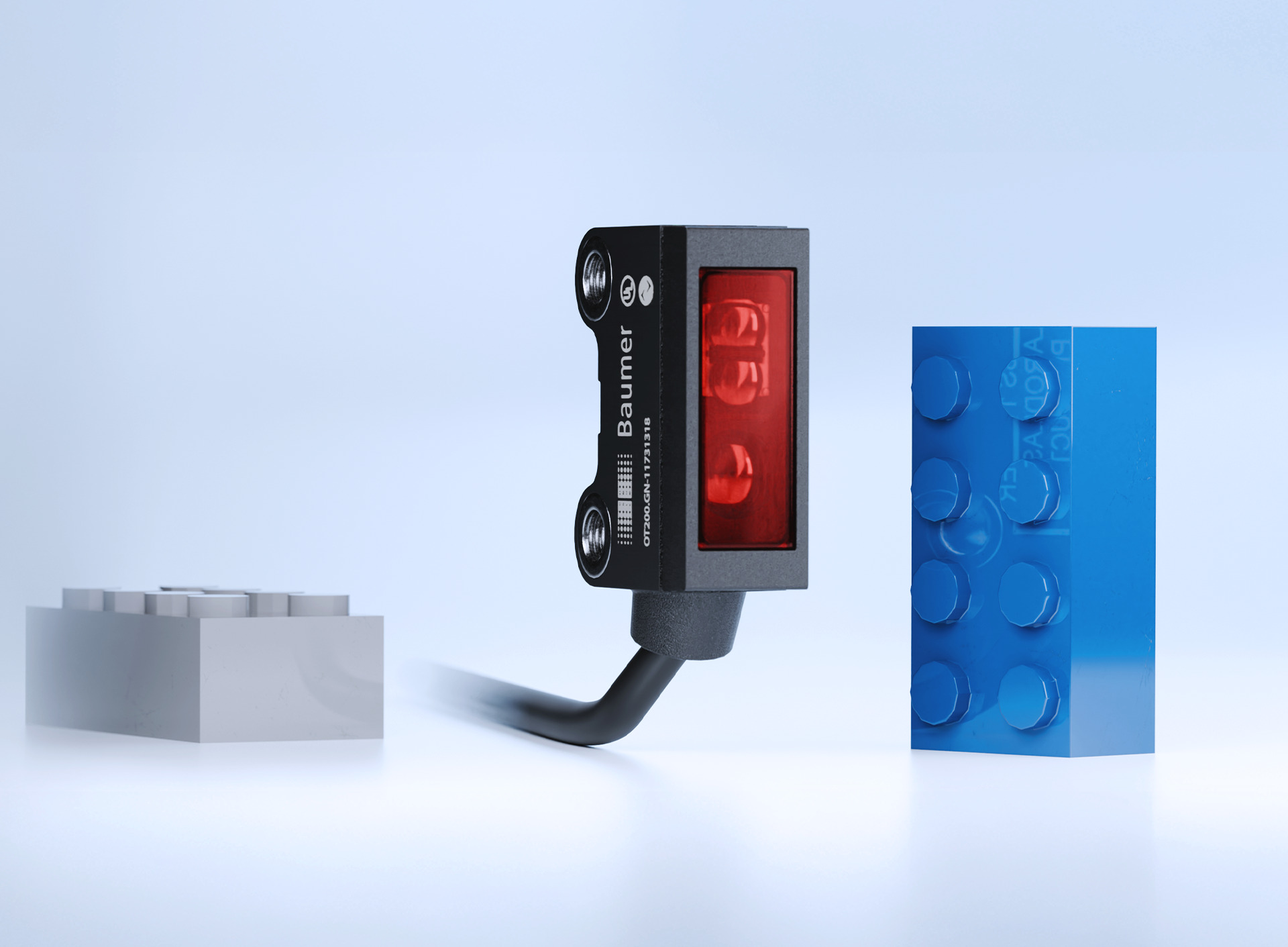

ToF-Kamera: Ein im Nahbereich arbeitender Chip misst Laufzeitunterschiede eines 940nm-VCSEL-Lasers und erzeugt Live-Tiefenbilder mit einer Reichweite von 3,9m. Die ToF-Kamera liefert 180×180px bei 30fps und hat ein horizontales Sichtfeld von 45°. In der Intralogistik ist die Maximierung der Lagerkapazität entscheidend. Kompakte Sensoren spielen dabei eine Schlüsselrolle: Höchste Leistung in kompakter Bauform schafft mehr Platz für die Ware, denn die Technik macht sich klein. ‣ weiterlesen

Intralogistik: Neue Baumer ToF-Sensoren machen sich klein

Lidar-Scanner: Für größere Distanzen kommt ein Laser-Scanner (Klasse 1) mit 40m Reichweite, ±1-cm Auflösung und ±2,5cm Genauigkeit zum Einsatz. Mit einer Laserfrequenz von 500Hz und einer Beam Divergence von 8mrad ermöglicht er schnelle Punktwolken zur Navigation oder Vermessung. Des Weiteren ermöglicht die Ausgabe der Motorpositionen Schwenk- und Neigungswinkel gemeinsam mit dem Abstand des Objekts spherische Koordinaten des Objekt im 3D Raum.

Die Kombination dieser drei Sensoren liefert umfassende Daten: Farbinformationen, Nahfeld-Tiefenbilder und präzise 3D-Punktwolken. Durch die frei programmierbaren Motoren lassen sich dynamische Sensorfahrten erstellen. Die minimale Schrittweite beträgt 0,5°, die Motorantwortzeit nur 0,33s für 60° Schwenkbewegung – besonders gut geeignet für schnelle Richtungswechsel.

Aufbau, Elektronik und Software

Das Gehäuse wird aus ASA-Kunststoff im 3D-Druck hergestellt und ist UV-resistent sowie temperaturbeständig. Ein optionaler STL-Download erlaubt die mechanische Integration in eigene Projekte. Das Gesamtgewicht beträgt ohne Grundplatte 0,82kg, sodass Temas auch auf mobilen Plattformen eingesetzt werden kann. MK|Ware schafft Transparenz in der Fertigung: Maschinenzustände, Auftragsdaten und Rückmeldungen stehen in Echtzeit bereit. ‣ weiterlesen

Shopfloor-Daten sinnvoll nutzen

Im Inneren arbeitet ein Raspberry Pi 5 als Einplatinencomputer. Er übernimmt die Fusion der Sensordaten, Echtzeit-Verarbeitung und die Generierung farbiger Punktwolken. Über Ethernet mit 2,5-Gbit/s werden die Daten an Host-PCs übermittelt. Die Software läuft unter Windows und MacOS und bietet eine grafische Benutzeroberfläche zur Steuerung der Gimbal-Bewegungen, zur Visualisierung der RGB- und Tiefenbilder und zum Export von .ply-Punktwolken.

Für Entwickler stellt Rubu PyPi-Pakete bereit, die sich in Robotik-Frameworks, KI-Programme oder Laborumgebungen einbinden lassen. Die Python-Schnittstellen geben Zugriff auf Rohdaten, Steuerbefehle für den Gimbal und Kamera-Parameter. Dank PoE genügt ein Netzwerkkabel für Strom, Daten und Steuerung, was die Integration in Robotik- oder Labornetzwerke erleichtert

Mögliche Anwendungen

Dank seiner modularen Architektur findet Temas in vielen Bereichen Einsatz:

- Robotics: Die Plattform liefert farbige Punktwolken zur Umfelderkennung und Hindernisvermeidung in mobilen Robotern. Der Multi-Sensor-Ansatz – ToF-Tiefendaten, RGB-Bilder und Lidar- sowie schnelle Motoren ermöglichen autonome Navigation auch in wechselnden Umgebungen.

- 3D-Mapping & Surveying: Für großflächige Kartierungen wird der Lidar-Scanner genutzt; nahe Strukturen erfasst die ToF-Kamera. Punktwolken lassen sich direkt als .ply-Datei exportieren; das ToF-System liefert dynamische Live-Punktwolken für Nahbereichsszenarien.

- Forschung & Bildung: Temas visualisiert physikalische Experimente in Echtzeit, z.B. Pendel- oder Fallversuche. Messdaten können live in Vorlesungen eingebunden werden, um abstrakte Phänomene anschaulich darzustellen. Des Weiteren können Feature Matching und SLAM-Anwendungen erforscht werden.

- Künstliche Intelligenz: Durch die Fusion von RGB-, Tiefen- und Geometriedaten entsteht ein reichhaltiger Trainingsdatensatz für Detektion und Klassifikation. Die separate Lidar- und ToF-Daten können die Erkennungsleistung signifikant verbessern.

- Virtual Reality/AR: In Kombination mit einem VR-Headset lassen sich Umgebungen immersiv erleben. Live-Visualisierung und Remote-Collaboration werden so realisierbar.

- Smart Home & IoT: Die 3D-Sensorik erkennt Räume, Objekte und Bewegungen in Echtzeit und liefert Grundlage für adaptive Automatisierung, Sicherheitssysteme und Komfortfunktionen.

- Darüber hinaus skizziert Rubu konkrete Use-Cases: Mobile Robotic Systems profitieren von der Sensorfusion und schnellen Motorsteuerung, um Hindernisse zu erkennen und autonom zu navigieren. Kollaborative Roboter nutzen die präzise 3D-Erfassung, um sicher und reaktionsschnell mit Menschen zu interagieren.