Ritu Favre hält die NI-Keynote bei ihrem DataTec-Besuch 2025. – Bild: DataTec AG

„Test ist kein isolierter Schritt mehr, sondern Teil der digitalen Wertschöpfungskette.“ Markus Kohler, DataTec – Bild: DataTec AG

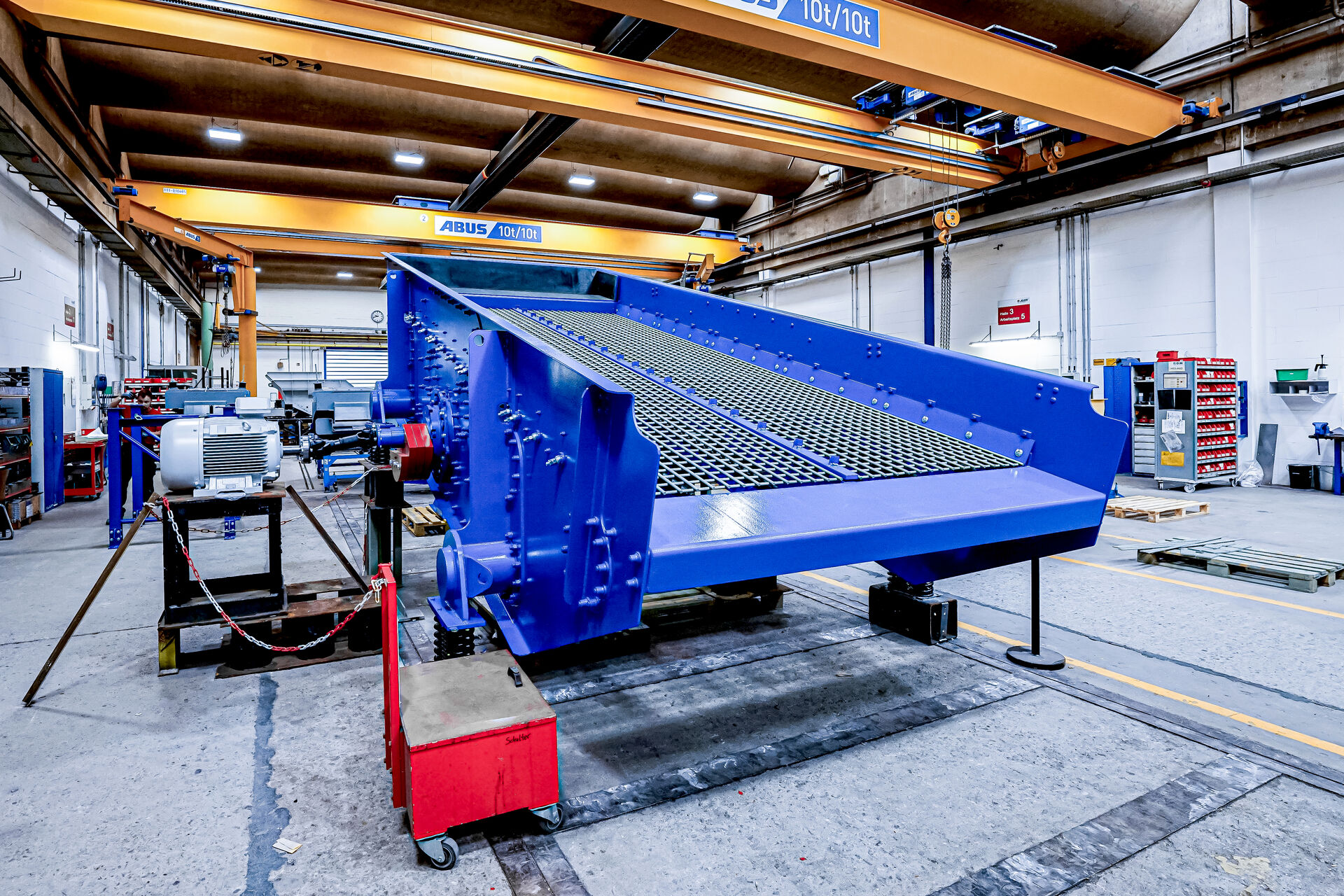

Ritu Favre besuchte das Logistikzentrum von DataTec in Reutlingen. – Bild: DataTec AG

Bild: dataTec AG

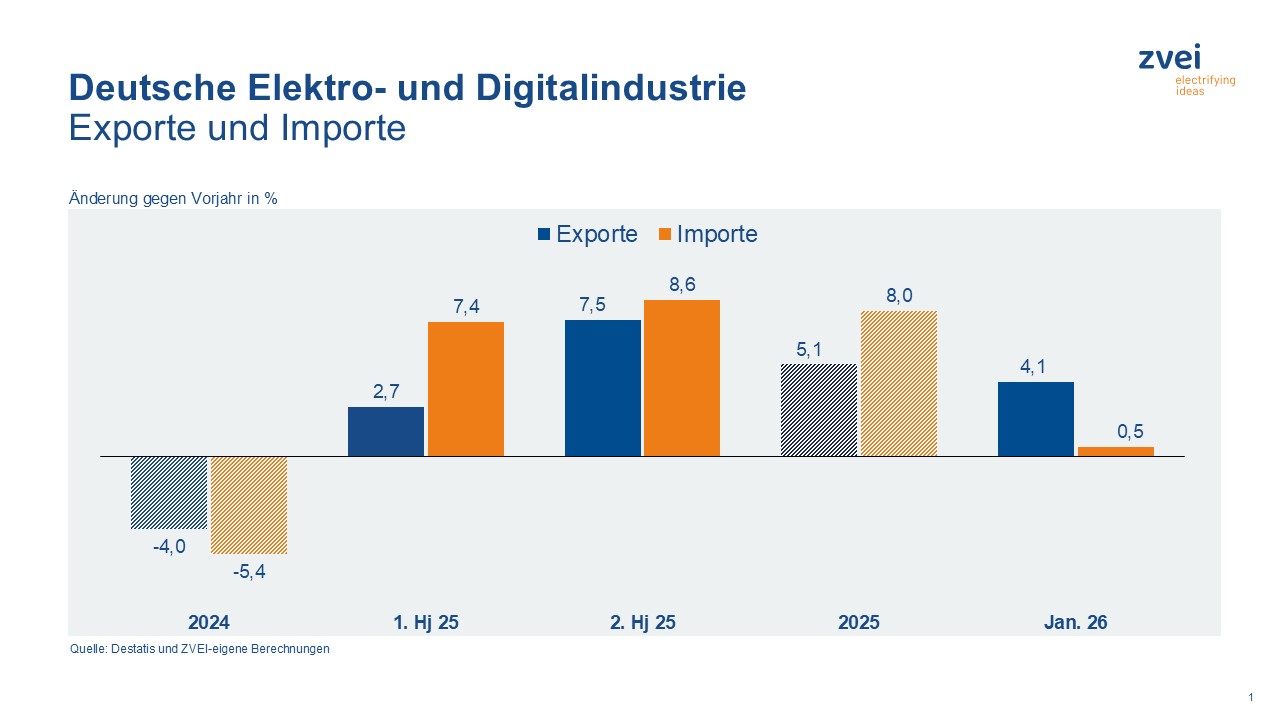

Welche technologischen Trends prägen derzeit den europäischen Automatisierungs- und Testmarkt?

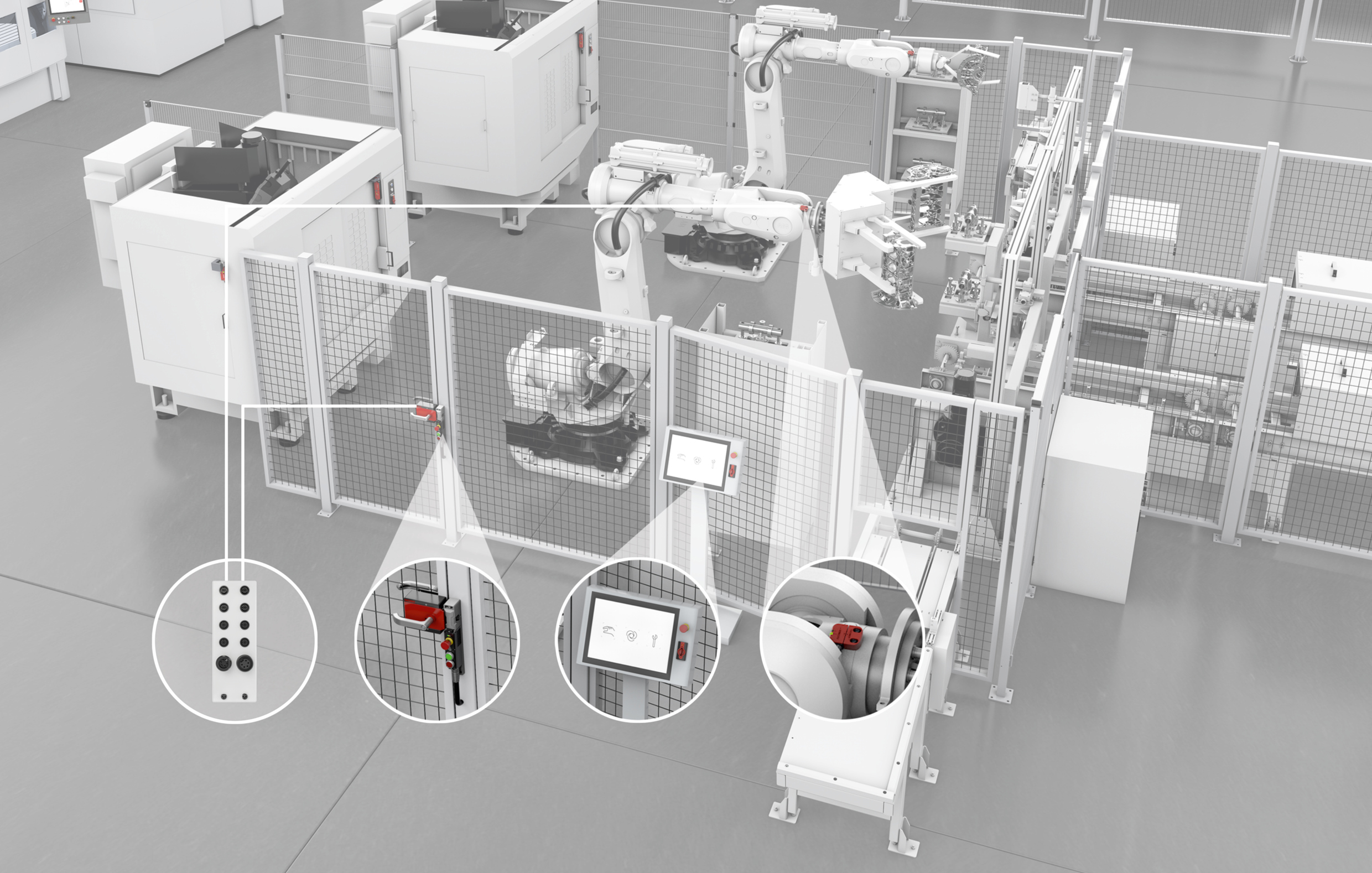

Markus Kohler: In Europa sehen wir drei strukturelle Entwicklungen, die den Test- und Automatisierungsmarkt nachhaltig verändern: Erstens steigt die Systemkomplexität signifikant – getrieben durch Elektrifizierung, softwaredefinierte Architekturen, Leistungselektronik und zunehmende Konnektivität. Produkte entwickeln sich von diskreten Komponenten hin zu hochintegrierten, vernetzten Systemen. Das erhöht die Anforderungen an Validierung, Systemsicherheit und Lebenszyklusmanagement erheblich. Zweitens gewinnt der datenbasierte Ansatz im Test deutlich an Bedeutung. Testsysteme erzeugen heute große Mengen hochauflösender Daten, die nicht nur zur Qualitätsentscheidung, sondern zunehmend zur Prozessoptimierung, Fehlerfrüherkennung und zur Absicherung regulatorischer Anforderungen genutzt werden. Drittens beobachten wir eine stärkere Integration von Testsystemen in unternehmensweite IT- und OT-Architekturen. Test ist kein isolierter Schritt mehr, sondern Teil einer durchgängigen digitalen Wertschöpfungskette. Gerade in Europa spielen dabei Aspekte wie Rückverfolgbarkeit, funktionale Sicherheit und regulatorische Konformität eine zentrale Rolle.

Wie adressiert NI diese Entwicklungen?

Ritu Favre: Mit steigenden Fähigkeiten und höherer Komplexität der Produkte wachsen auch die Anforderungen der Industrie an flexible, modulare und skalierbare Testsysteme, die sich an veränderte technologische Rahmenbedingungen anpassen lassen und mit ihnen mitwachsen. Unsere Antwort darauf ist die flexible, modulare und skalierbare NI-Testplattform, die sich einfach an wandelnde Anforderungen anpassen lässt, Testdaten über den gesamten Produktlebenszyklus strukturiert nutzbar macht und neue Technologien wie KI zukunftssicher integriert.

Viele Teams kombinieren NI LabView mit SPS, Python und modellbasierter Entwicklung. Welche neuen Funktionen oder Entwicklungen sind hier zu erwarten?

Ritu Favre: Hybride Entwicklungsumgebungen sind heute Realität in Ingenieursteams. NI Labview wird für die Instrumentensteuerung, Echtzeitverhalten und bedienerzentrierte Workflows eingesetzt, SPS für deterministische Maschinensteuerung, Python für Analytik und Automatisierung sowie modellbasierte Werkzeuge für Simulation und Verifikation. Die zentrale Herausforderung besteht dabei nicht darin, sich für eine Programmiersprache zu entscheiden, sondern stabile Workflows zu schaffen, in denen diese Technologien zuverlässig zusammenarbeiten und über viele Jahre hinweg weiterentwickelt werden können. Wir investieren daher gezielt in Interoperabilität und Workflow-Integration. Dazu gehört unter anderem eine engere Python-Integration, sodass Teams bestehende Python-Bibliotheken für Analysen, Reporting und Automatisierung nutzen können, während die robuste Hardwareansteuerung und Testausführung weiterhin im NI-Umfeld erfolgen. Zusätzlich sehen wir einen großen Bedarf an einer besseren Zusammenarbeit zwischen Test- und Automatisierungsingenieuren, insbesondere in SPS-gesteuerten Linien mit standardisierten Schnittstellen und einer klaren Trennung zwischen Maschinensteuerung und Testorchestrierung. Auf der Engineering-Seite wünschen sich Kunden zudem bessere Möglichkeiten zur Strukturierung großer Test-Codebasen, zur Wiederverwendung von Software sowie zur Vereinfachung von Validierung und Dokumentation. Entsprechend werden wir die Unterstützung für modulare Entwicklung, Versionsmanagement und skalierbare Bereitstellung weiter ausbauen. Am Ende geht es nicht nur darum, Testcode schneller zu schreiben, sondern Testsysteme über den gesamten Lebenszyklus hinweg stabil, wartbar und erweiterbar zu halten.

Wie entwickelt Emerson die Architekturen von NI PXI, NI DAQ und synchroner Messtechnik weiter, um Anforderungen wie Multi-Sensor-Setups, End-of-Line-Tests, Sicherheit und Hochgeschwindigkeitsanwendungen zu unterstützen?

Ritu Favre: In Branchen wie Automotive, Luft- und Raumfahrt oder industrieller Elektronik sehen wir steigende Anforderungen an Kanalanzahl, Synchronisation und die Integration komplexer Sensorsysteme. Multi-Sensor-Anwendungen und End-of-Line-Tests erfordern Determinismus, Wiederholgenauigkeit und eine robuste Zeit- und Synchronisationsarchitektur – insbesondere, wenn Signale aus unterschiedlichen physikalischen Domänen wie Elektrik, Mechanik und Thermik korreliert werden müssen. Auf Plattformebene investieren wir kontinuierlich in die Weiterentwicklung unserer NI-PXI- und NI-DAQ-Produktfamilien mit Fokus auf höhere Datenraten, präzisere Zeit- und Synchronisationsmechanismen sowie skalierbare Architekturen. Synchrone Messtechnik bedeutet dabei nicht nur hohe Abtastraten, sondern vor allem eine zuverlässige, reproduzierbare Korrelation über alle Kanäle und Instrumente hinweg, die auch im Produktionsumfeld dauerhaft funktioniert. Für den Einsatz in der Produktion legen wir besonderen Wert auf Eigenschaften wie Robustheit, Kalibrier- und Rückverfolgbarkeitskonzepte, vorhersehbares Systemverhalten unter Last sowie effiziente Testzeiten. Sicherheitsanforderungen fließen ebenfalls in das Systemdesign ein. Unternehmen benötigen Architekturen, die einen sicheren Betrieb, eine klare Trennung von Funktionsbereichen und dokumentationsfähige Prozesse unterstützen. Ziel ist es, Teststationen zu ermöglichen, die sich von Prototypen in der Entwicklung bis hin zur stabilen Serienproduktion skalieren lassen – ohne dass Systeme grundlegend neu entwickelt werden müssen.

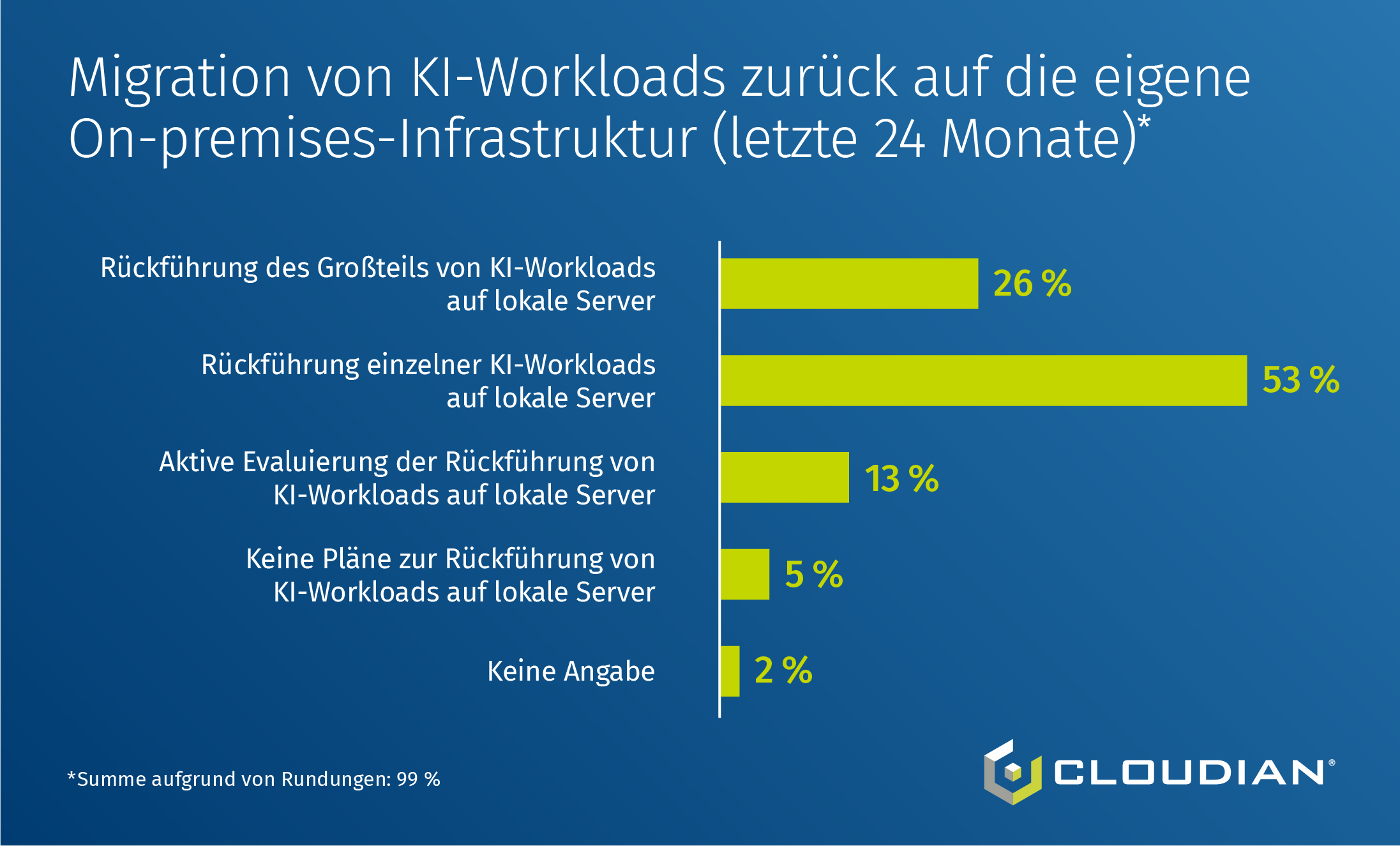

Welche KI-gestützten Funktionen plant Emerson kurzfristig für seine NI-Software- und Testplattformen, und für welche Anwendungsfälle sind diese gedacht?

Ritu Favre: Im Testumfeld muss KI einen klar messbaren Mehrwert bieten. Den größten kurzfristigen Nutzen sehen wir in Anwendungsfällen wie der Reduzierung des Engineering-Aufwands, einer schnelleren Fehlersuche sowie einer besseren Entscheidungsfindung auf Basis von Testdaten. Diese Überlegungen spiegeln sich in unserer KI-Roadmap wider, die gezielt auf die tägliche Arbeit von Ingenieuren ausgerichtet ist und nicht auf abstrakte KI-Versprechen. Ein erster sichtbarer Schritt ist NI Nigel AI, das derzeit vor allem als Advisor innerhalb der NI-Softwareumgebung fungiert. In seiner aktuellen Ausprägung unterstützt Nigel Ingenieure dabei, sich in der Software zurechtzufinden, Testaufbauten besser zu verstehen und typische Entwicklungs- sowie Troubleshooting-Aufgaben schneller zu erledigen. Der Fokus liegt dabei auf Kontext, Orientierung und Produktivität.

Das ist jedoch erst der Anfang. Im Laufe des Jahres 2026 planen wir, diese KI-Funktionen schrittweise weiterzuentwickeln – vom Advisor hin zu einem leistungsfähigeren Assistenten und in ausgewählten Anwendungsfällen zu agentenbasierten Funktionen, etwa im Bereich Code-Unterstützung. Treiber dieser Entwicklung sind konkrete Anforderungen aus dem Engineering-Alltag, wie eine tiefere Unterstützung von Testentwicklungs-Workflows, fortgeschrittene Debugging- und Root-Cause-Analysen sowie eine schnellere Auswertung großer Testdatenmengen durch Trendanalysen und intelligentes Reporting. Gleichzeitig bleiben Data Governance und der Schutz geistigen Eigentums zentrale Designprinzipien. Viele Kunden möchten die Vorteile von KI nutzen, ohne die Kontrolle über sensible Daten zu verlieren. Für uns ist die sichere Bereitstellung dieser Funktionen ebenso wichtig wie ihre technische Leistungsfähigkeit. Unser Ziel ist es, KI zu einem praktischen Engineering-Partner über die gesamte NI-Plattform hinweg zu machen – für mehr Geschwindigkeit, Konsistenz und Qualität, bei voller Kontrolle durch den Menschen.

Welche technologischen oder organisatorischen Schritte empfehlen Sie als DataTec ihren Kunden, um ihre Test- und Produktionssysteme für die kommenden Jahre zu stärken?

Markus Kohler: Technologisch empfehlen wir unseren Kunden, Testarchitekturen konsequent modular und standardisiert zu konzipieren. Skalierbarkeit darf kein nachträgliches Ziel sein, sondern muss von Beginn an integraler Bestandteil des Systemdesigns sein. Offene Schnittstellen, klar getrennte Funktionsbereiche und wiederverwendbare Softwaremodule reduzieren langfristige Integrations- und Wartungskosten erheblich. Zugleich sollten Unternehmen Testdaten als strategisches Asset verstehen. Wer Daten strukturiert erfasst, kontextualisiert und systematisch auswertet, schafft die Grundlage für kontinuierliche Prozessverbesserung, schnellere Ursachenanalysen und eine belastbare regulatorische Absicherung. Ebenso entscheidend ist ein aktives Lebenszyklusmanagement. Testsysteme bleiben häufig zehn Jahre oder länger im Einsatz. Updates, Cybersecurity-Anforderungen und Validierungspflichten müssen daher organisatorisch wie technisch von Anfang an eingeplant werden.

Organisatorisch zeigt unsere Erfahrung, dass erfolgreiche Unternehmen Test nicht als isolierte Disziplin begreifen. Entscheidend ist die enge Verzahnung von Entwicklung, Testengineering, Produktion sowie IT und OT. Die Wahl der richtigen Technologie ist wichtig. Für langfristige Skalierbarkeit und Nachhaltigkeit sind jedoch klare Governance-Strukturen, eindeutig definierte Verantwortlichkeiten und qualifizierte Teams ausschlaggebend. Vor diesem Hintergrund unterstützen wir unsere Kunden über die DataTec Akademie gezielt beim Kompetenzaufbau ihrer Test- und Automatisierungsteams. Nachhaltige Teststrategien entstehen nicht allein durch Technologie, sondern durch systematisch aufgebautes Knowhow im Unternehmen.