Teststellungen zwischen Mensch und Maschine

Eine Gestensteuerung kann man als eine Kette von Übergabepunkten für Signale verstehen, und jede Übergabe ist eine potenzielle Fehlerquelle und muss im Modell sowie am fertigen System getestet werden. Das fängt wohlgemerkt schon beim Menschen an und mit der Frage, ob er das, was er der Maschine sagen will, auch \’richtig rüber bringt\‘. Folgende Fragen sind zu beantworten:

- Sind die Gesten verständlich und erlernbar?

- Erlauben sie präzise Befehle?

- Auf welche Fehler des Bedieners muss das System vorbereitet sein?

- Welche Qualität haben die Signale der Sensorik?

- Welche Qualitätsschwankungen können beherrscht werden?

- Wird die Funkübertragung inklusive ihrer Unterbrechung beherrscht?

- Funktioniert die Übersetzung in semantische Befehle?

- Funktioniert die inverse Kinematik? Funktionieren Kollisionsvermeidungen und Notabschaltungen?

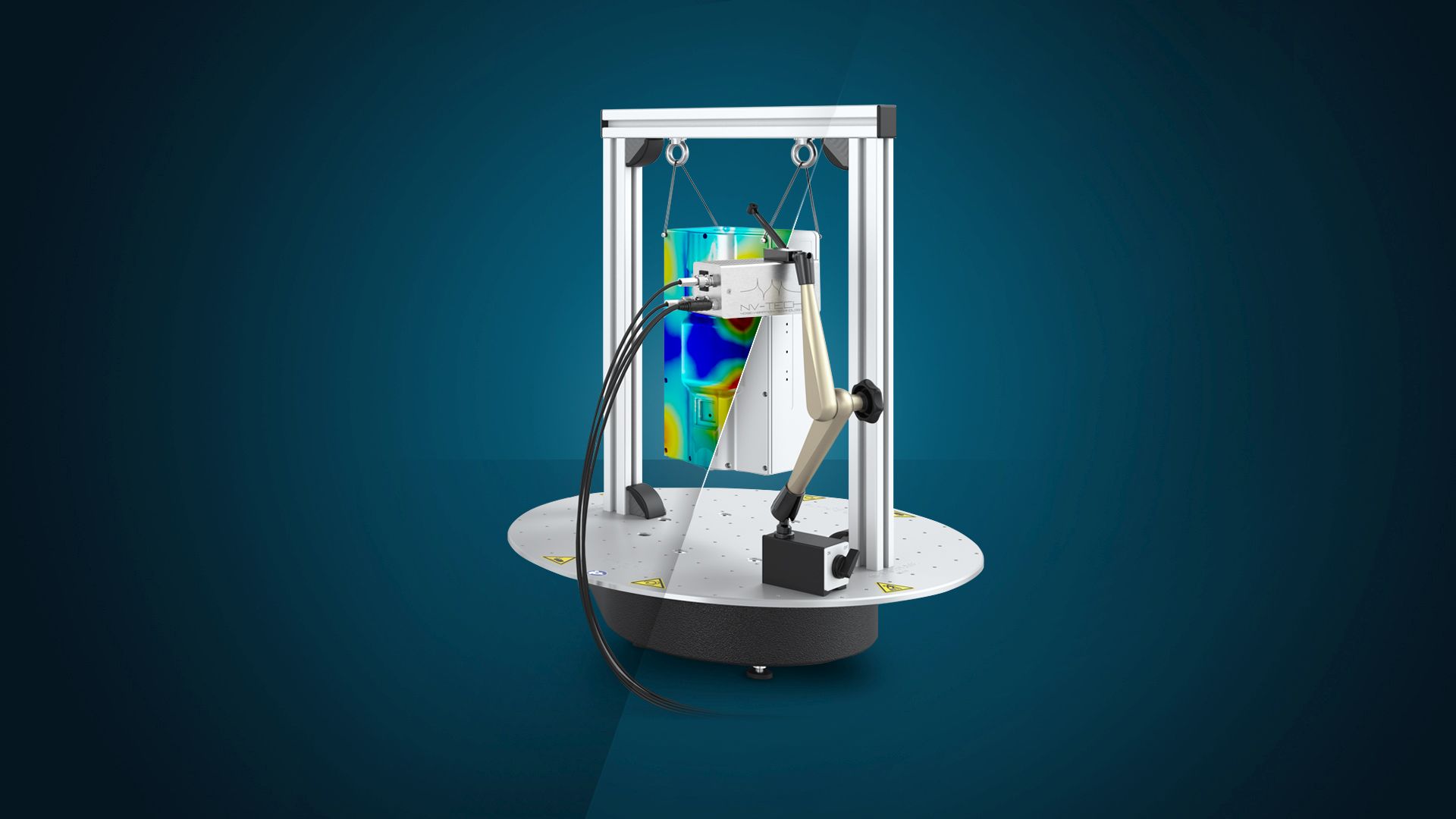

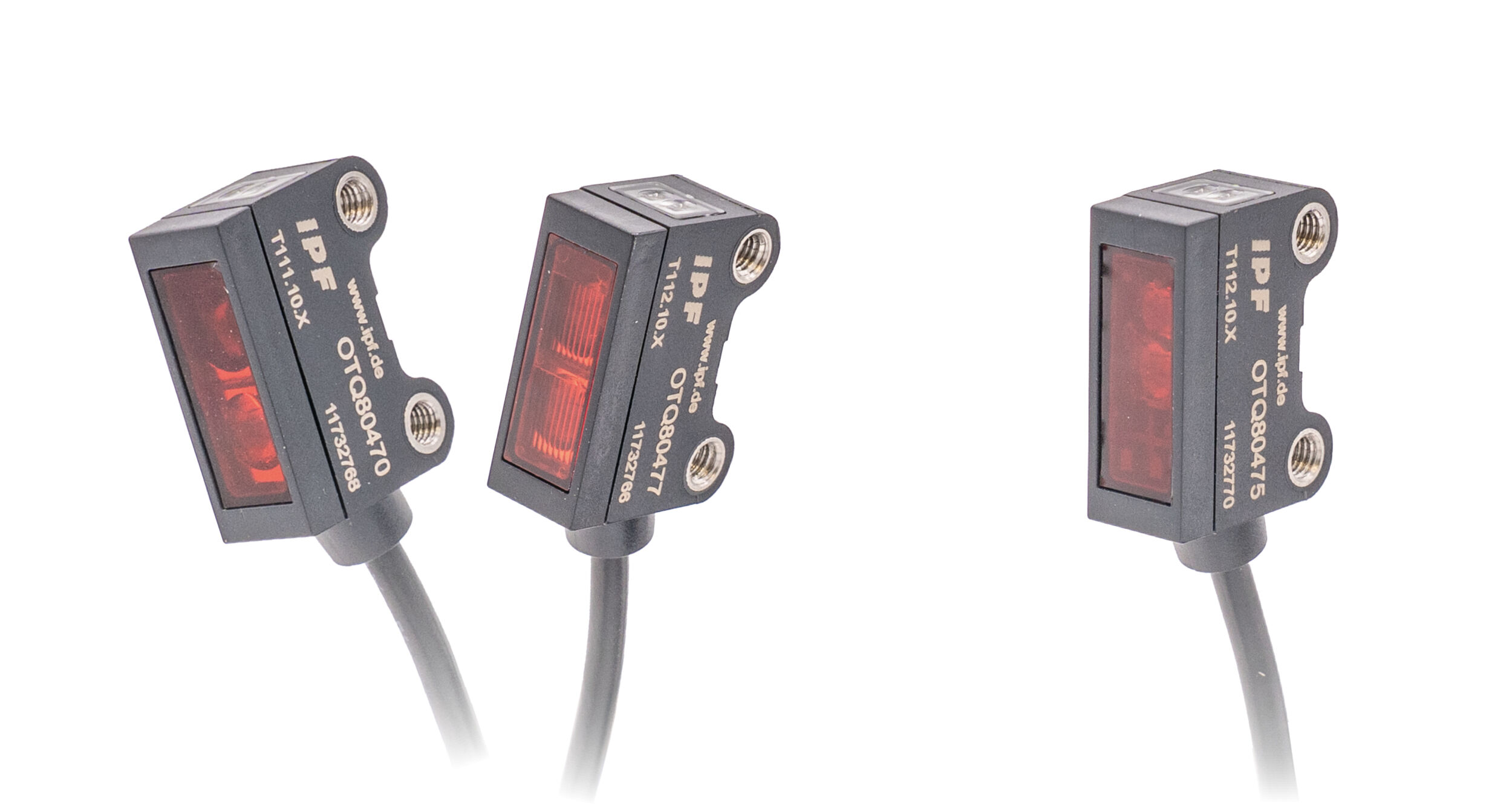

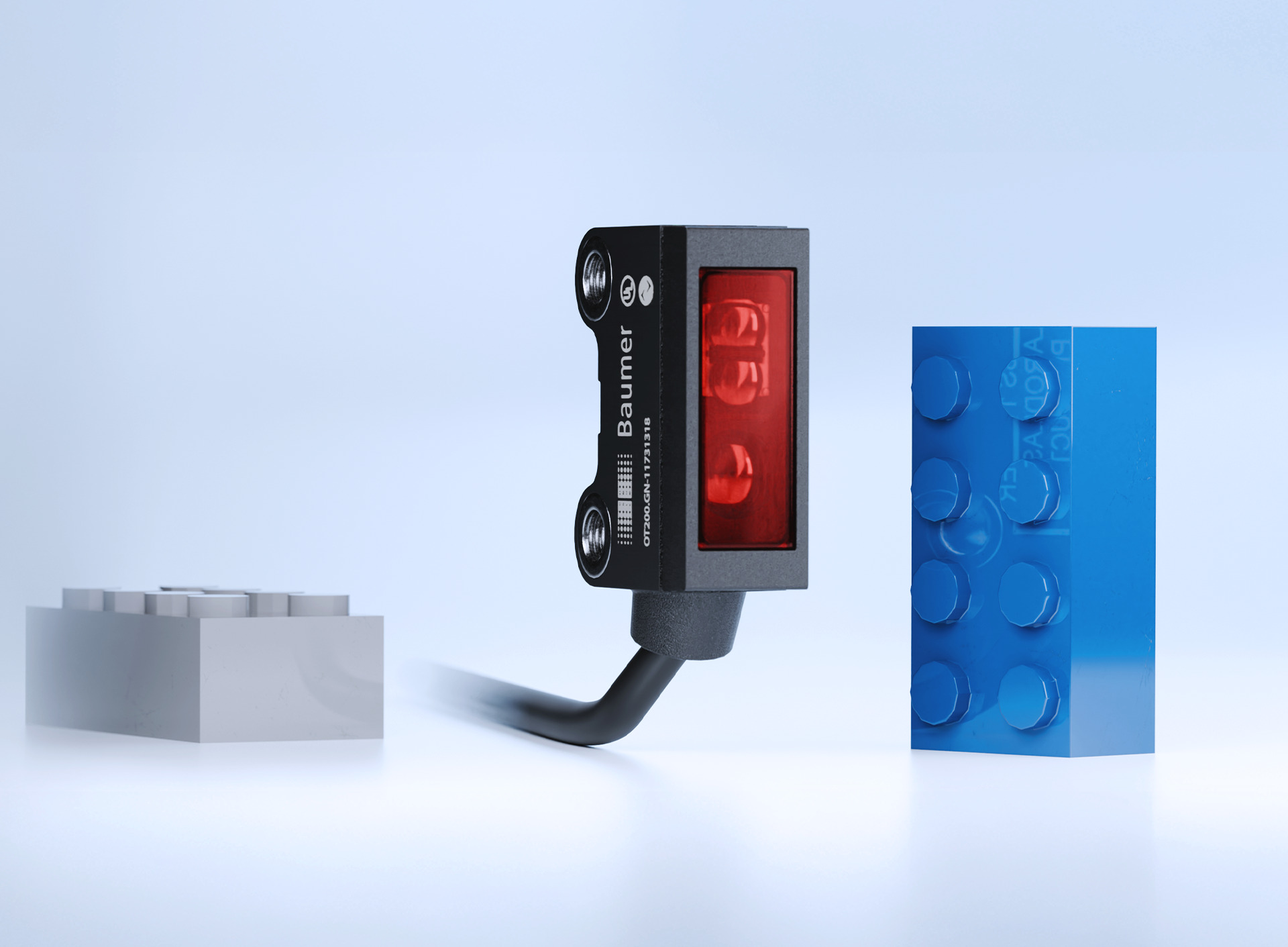

Die Gestensteuerung beispielsweise mit einer Handy-App – wie von Berner & Mattner für einen Anwender entwickelt – ist sicher eine Spezialanwendung, um zum Beispiel einen Quadrocopter mit Messgeräten zu bedienen. Doch der Entwicklungs- und Testaufwand wird nicht wesentlich geringer, wenn sich die Gestensteuerung auf Touchdisplay-Wischgesten auf einem Tablet beschränkt. HMIs modellbasierend und entwicklungsbegleitend zu testen, ist daher in jedem Fall ein empfehlenswerter Ansatz. In der Intralogistik ist die Maximierung der Lagerkapazität entscheidend. Kompakte Sensoren spielen dabei eine Schlüsselrolle: Höchste Leistung in kompakter Bauform schafft mehr Platz für die Ware, denn die Technik macht sich klein. ‣ weiterlesen

Intralogistik: Neue Baumer ToF-Sensoren machen sich klein

In der Machbarkeitsstudie Smart Multi-Axis Control wurden bis auf Smartphone und Mehrachs-Demonstrator alle Komponenten von Berner & Mattner entwickelt – von der Smartphone-App über den Java-basierten Server, die Controller des Roboterarms bis hin zu Messina, der Plattform für das modellbasierte Testen von Steuergeräten und HiL-Echtzeitanwendungen. Die App gibt die Sensordaten und Benutzereingaben über WLAN an den Server zur Sensorikvorverarbeitung. Hier wird die Semantik der Befehle (zum Beispiel \’fahre zur Position yxz\‘) gebildet, die dann an das Echtzeitsystem Messina gehen. Dieses führt die inverse Kinematik, die Umrechnung von Koordinaten des Greifers in Winkel der einzelnen Gelenke durch. Hieraus leiten die Embedded-Systeme des Demonstrators die Servobefehle ab.