Industrieserver können dank zunehmender Rechenperformance und der Multicore- und Virtualisierungs-Technologie, durch die es möglich wird, dezentrale Aufgaben auf einzelne Cores eines einzelnen Servers zu verteilen, zunehmend wieder zentrale und extrem mächtige Steuerungsaufgaben erfüllen. Und dies parallel zur Einführung von Industrial-Ethernet-Lösungen, mit denen auch gleichzeitig hinreichend Bandbreite zur Kommunikation bis hin zum Feld zur Verfügung gestellt wird. Die während der Einführung von Feldbussystemen totgesagten zentralen Steuerungen gewinnen damit erneut an Attraktivität. Manche zwischengelagerte Systeme können hier integriert werden. Im Feld könnten dann nur noch einfachere Embedded Ethernet Devices verbleiben. Nun soll hier nicht der Eindruck entstehen, dass man die Diskussion über zentrale oder dezentrale Steuerungen erneut anfachen will. Die Wahrheit liegt je nach Applikation immer zwischen komplett dezentral und komplett zentral. Doch unter den gegebenen technologischen Möglichkeiten rein von der Hardware her betrachtet – heute kann man die Steuerungssoftware auf unterschiedliche Hardware portieren, was bei früheren SPSen nicht gegeben war – gewinnt der zentrale Industrieserver zunehmend an Bedeutung. Vorteile der Server-basierten Automatisierung Dies bietet für Maschinen- und Anlagenbauer einige Vorteile, die im Wesentlichen durch die verfügbare Multicore-Prozessor-Technologie und Virtualisierung sowie durch die mit der Hardware gleichzeitig kosteneffizient verfügbar werdenden (Remote-)Management-Lösungen ermöglicht werden. Bei zentralen Servern sind Datensicherung, Wartung und IT-Administration deutlich einfacher als bei verteilten, heterogenen Systemen. Wartung und Systempflege sowie ggf. nötige Instandsetzungsarbeiten reduzieren sich auf ein System, anstatt über mehrere, örtlich verteilte. So kann auf Wunsch auch Remote, beispielsweise via im Chipsatz integrierter Intel Active Management Technologie (AMT) oder über Remote-Condition-Monitoring-Lösungen für Server wie beispielsweise Kontron PCCM (PC Condition Monitoring), umgesetzt werden. Datensicherungslösungen lassen sich bei einer zentralen Struktur wesentlich effizienter und konsequenter umsetzen. Auch die Performance-Reserven, die bei jedem System eingeplant werden müssen, könnten sich die zentralisierten Systeme teilen, sodass in der Summe Ressourcen eingespart werden. Puffer brauchen nur einmal und nicht für jedes dezentrale System einzeln eingebaut zu werden. Auch bei steigenden Hardwareanforderungen durch beispielsweise Softwareupgrades oder Erweiterung muss nur an einer Stelle die Hardware angepasst werden. Zudem muss der Aufwand zum Schutz dieser Systeme vor Schmutz und sonstigen Umfeldeinflüssen nur einmal betrieben werden. Hinzu kommt, dass durch die Multicore-Technologie und die verfügbare Virtualisierungstechnologie eine Applikation selbst nicht mehr zwingend an einen bestimmten Hardwareort gebunden ist. Die Systeme im Sinne von Softwareapplikationen/Steuerungen werden dabei in kleinere (Core-)Einheiten (Tasks, Prozesse etc.) aufgegliedert. Ist die Software auf Single-Core Hardware hin optimiert, kann sie in einer eigenen virtuellen Maschine dediziert auf einem Prozessor-Core laufen. Bei diesem Vorgehen sind nicht einmal Softwareanpassungen nötig, was einen schnellen und unkomplizierten Umstieg ermöglicht. Auf diesem Weg lassen sich Applikationen parallelisieren, ohne großen Aufwand bei der Softwareentwicklung zu betreiben. Dezentrale Clients werden schlank Sind auf einem zentralen Industrieserver einmal alle Steuerungs- und MMI-Server-Funktionen vereint, so können die jeweils dezentralen Einheiten über Industrial-Ethernet-Protokolle angesprochen werden. Vorteilhaft ist dabei eine einheitliche Verkabelungsinfrastruktur, die für unterschiedliche, nicht untereinander kompatible Industrial-Ethernet-Protokolle genutzt werden kann. Zunehmend interessant wird auch bei den dezentralen Einheiten das Server-basierte Computing, wenn man die dezentralen Systeme so auslegt, dass sie die Applikation über den zentralen Server durch das Booten beziehen. In diesem Falle ließen sich die Managementvorteile, die man durch den zentralen Server erzielen kann, auch auf die dezentralen Clients übertragen. Interessant sind solche Lösungen für nahezu alle Applikationen, bei denen die Netzwerkperformance einer Full-Duplex-Ethernet-Leitung ausreicht – ganz gleich ob 10Mbit oder 10Gbit. Cloud Computing – Ein potenzielles Zukunftsszenario? Verfolgt man diesen Gedanken der Zentralisierung weiter, sind derzeit noch eher theoretisch anmutende Lösungen realisierbar, die via VPN standortunabhängig von einem zentralen Server aus gebootet werden. So sind beispielsweise Applikationen denkbar, bei denen Maschinen vom Server des Herstellers gebootet werden. Eine solche Konfiguration wäre vergleichbar zu Web-Applikationen, die derzeit für Office-Software verfügbar sind: Die Applikation würde weitestgehend via Internet-Access bereitgestellt. Viel diskutiert werden solche Ansätze derzeit auch unter dem Thema \’Cloud Computing\‘. Die IT-Branche geht davon aus, dass bis 2012 rund 80 Prozent der Fortune-1000-Unternehmen Cloud-Computing-Lösungen nutzen werden und dass Cloud-Computing-Lösungen bis zum Jahr 2015 rund die Hälfte aller neuen Enterprise IT ausmachen werden. Harte Echtzeit-Lösungen wären mit einer solchen Struktur derzeit allerdings aufgrund einer nicht exakt definierbaren Latency noch nicht möglich. Mit dem Ausbau der Netzwerkinfrastrukturen, die bald sogar dreifach-HDTV-Streams erlauben und passende QoS für z.B. Internet-Telefonie sowie fest garantierte Bandbreiten bereitstellen werden, ist auch das nur noch eine Frage der Zeit. Die Weichen für solche Applikationen sollten Unternehmen heute schon stellen und sich darüber hinaus fragen, wie sich das Balancing der Softwareapplikationen in den nächsten Jahren verändern wird, und ob die Software als Service zentral geladen werden soll oder ob Dezentralität mehr Nutzen verspricht. Als Beispiele seien hier die industrielle Bildverarbeitung oder CNC-Maschinen genannt, die schon heute modulare Software verwenden. Je nach Aufgabe lassen sich Bearbeitungsalgorithmen modular laden und nutzen. Dabei wären zukünftig Modelle vorstellbar, bei denen über den zentralen Server die einzelnen Module geladen werden und entsprechend der Nutzung kostengünstig abgerechnet wird. Ein solches Szenario ist also immer (und vermutlich auch nur dann) von Interesse, wenn modulare Lösungen nutzungsabhängig vom OEM zur Verfügung gestellt werden sollen und man mehr oder weniger nur mit dezentralen Clients arbeiten und auf den Server vor Ort verzichten kann. Für die meisten Aufgaben in der Automatisierung wird es jedoch eher autonome Lösungen geben, die unabhängig vom Netz sind und bei denen der lokale Server vielleicht einen schlanken Freischaltungscode mit Zeitstempel vom Hersteller erhält. Zentralisierung heute Wie auch immer die Zukunft aussehen wird: In die Automatisierung eingezogen sind auf jeden Fall schon Server, die dezentrale Computer mit der kompletten Software über das Netz versorgen. Die dezentralen Kamera-Rechner booten über Ethernet vom zentralen Server und laden von dort auch die Applikationssoftware inklusive Parameter für die jeweilige Bildverarbeitungsaufgabe. Das Prüfergebnis wird an den zentralen Server weitergeleitet, der für die übergeordneten Kontrollfunktionen der Verarbeitungslinie verantwortlich ist. Dieses Systemkonzept macht das Inspektions- und Kontrollsystem von Krones, in dem CompactPCI-Baugruppen an den Kameras eingesetzt werden, äußerst flexibel und kostengünstig. So können die hardwaretechnisch identischen Bildverarbeitungseinheiten in einer breiten Palette unterschiedlicher Applikationen eingesetzt werden. Zudem ermöglicht dieses Konzept die Serienfertigung der Systeme bei minimalen Integrationskosten, unabhängig davon ob die Systeme für Messungen, Oberflächenkontrolle, Code- oder Texterkennung, Druck- oder Gravurkontrolle oder zur Materialkontrolle eingesetzt werden. Zudem ist darüber auch sichergestellt, dass bei einem Ausfall Ersatzsysteme immer schnell zur Hand sind, da kein applikationsspezifischer Ersatz benötigt wird. Es sind aber auch Lösungen denkbar, in denen beispielsweise ein Hutschienen-PC mit angeschlossenem IO-System, wie er z.B. mit dem Kontron ThinkIO verfügbar ist, seine spezifische Applikation komplett über Ethernet beziehen kann. Klassische Remote-Boot-Konzepte sind auch für die Visualisierung mit ThinClients ein bereits praxiserprobtes Beispiel. Durch Auslagerung der Aufgaben von den bislang leistungsfähigeren Panel-PCs hin zum zentralen Server im Schaltschrank lassen sich die dezentralen Einheiten somit auch preisgünstiger und zusätzlich flexibler gestalten: Wenn die Bedienterminals die gesamte Software-Applikation komplett vom Server aus starten, erhalten sie ihre genaue Funktion erst in diesem Moment. Vorteile der ThinClients sind insbesondere die oben erwähnten Vorteile, die der zentrale Server bietet. Für die dezentralen Einheiten gilt darüber hinaus: Thin-Clients können deutlich robuster ausgelegt werden, da sie aufgrund ihrer reduzierten Hardwareausstattung komplett geschlossen und lüfterlos gekühlt sein können und ohne rotierende Speichermedien arbeiten. Sie sind somit weniger anfällig gegenüber Vibrationen und Verschmutzung und führen zu einer höheren Verfügbarkeit des Gesamtsystems. Nicht immer wird aber eine solche zentrale Lösung der Weisheit letzter Schluss sein. Oft wird man auch Aufgaben dezentral halten wollen, um Traffic zu reduzieren oder einfach nur die Insellösung beizubehalten und einmal getätigte Investitionen nicht zu verlieren. Ganz gleich wie das jeweilige Balancing beim Server oder dezentralen Client ausfällt: Unternehmen wie Kontron können jedwede Konstellation anbieten und damit auch entsprechend unabhängig beraten, wenn es um die Auslegung der jeweiligen PC-Systeme geht, da man nicht nur beispielsweise einen Hutschienen-PC anbietet oder aber einen Panel-PC oder Industrieserver, sondern all diese Lösungen in jeweils bedarfsgerecht skalierbarer Performance. Eine plattformunabhängige Vertriebsstrategie garantiert auf den jeweiligen Anwendungsfall hin optimierte Lösungen. So hat Kontron beispielsweise für ein Schienenverkehrsprojekt in Polen sowohl KISS-Server für die Leitebene geliefert als auch CompactPCI und VME-Systeme für die Automatisierungsebene. Der Anwender profitiert in diesem Fall von einem einzigen Ansprechpartner für die gesamte diversifizierte Hardwareinstallation. Nicht alleine jedoch die Beratung ist von Bedeutung. Letztlich kann sich der Bezug von z.B. Server und ThinClient aus einer Hand auch positiv auf die die Gesamtkosten für eine Anlage niederschlagen. Insofern sollten OEM darüber nachdenken, ob und inwieweit sie den Einkauf von IPC-basierten Lösungen nicht zentralisieren und ihre einzelnen Abteilungen anweisen, den Bezug bei Generalisten wie Kontron zu bündeln, um so Gesamtkostenvorteile zu erzielen. Halle 12, Stand 404

Industrial Client-Server Computing Die Gesamtlösung im Visier

-

Vorsprung im Packaging

Automatisierungstechnik von Beckhoff ermöglicht die effiziente Entwicklung ressourcenschonender Verpackungsmaschinen, verkürzt Konstruktionszeiten und senkt Kosten – für innovative Lösungen und nachhaltige Produktionsprozesse.

-

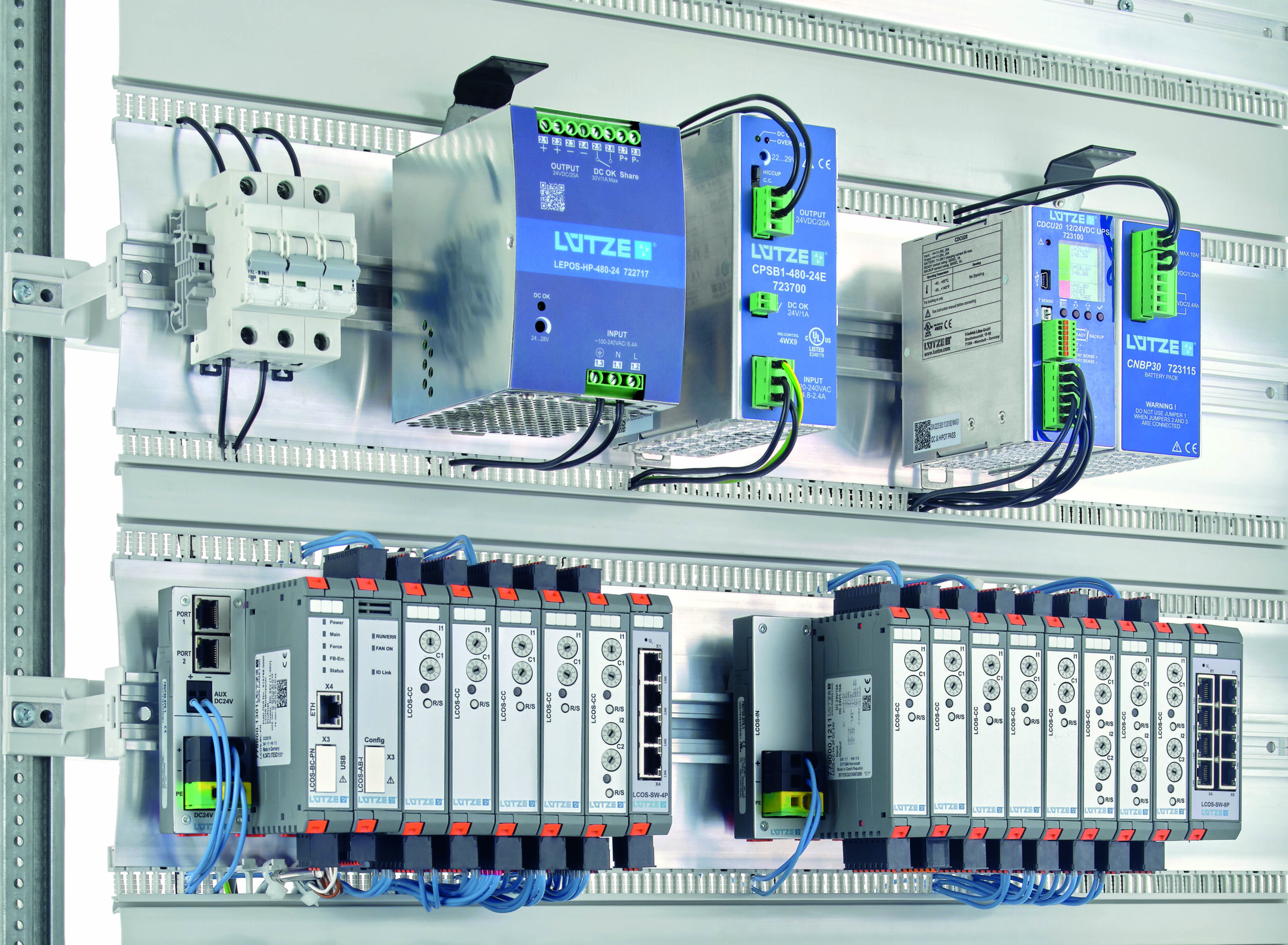

Leistungsfähige Netzgeräte mit intelligenter Lastüberwachung

Der Mix macht’s

Bei industriellen Stromversorgungen stehen heute neben der reinen Energiebereitstellung Themen wie Effizienz, Diagnosefähigkeit und Ausfallsicherheit im Fokus. Eine gute Lösung entsteht erst durch das Zusammenspiel von Netzgerät und…

-

Automatisierung für mobile Roboter in der Produktion

Smarter Transport für beengte Umgebungen

Enge Gassen, platzoptimierte Bereiche, kaum Raum für Fehler: Moderne Produktions- und Lagerhallen nutzen jeden Quadratmeter effizient aus. Genau für diese anspruchsvollen Bedingungen hat Nipper seine fahrerlosen Palettentransportfahrzeuge mit…

-

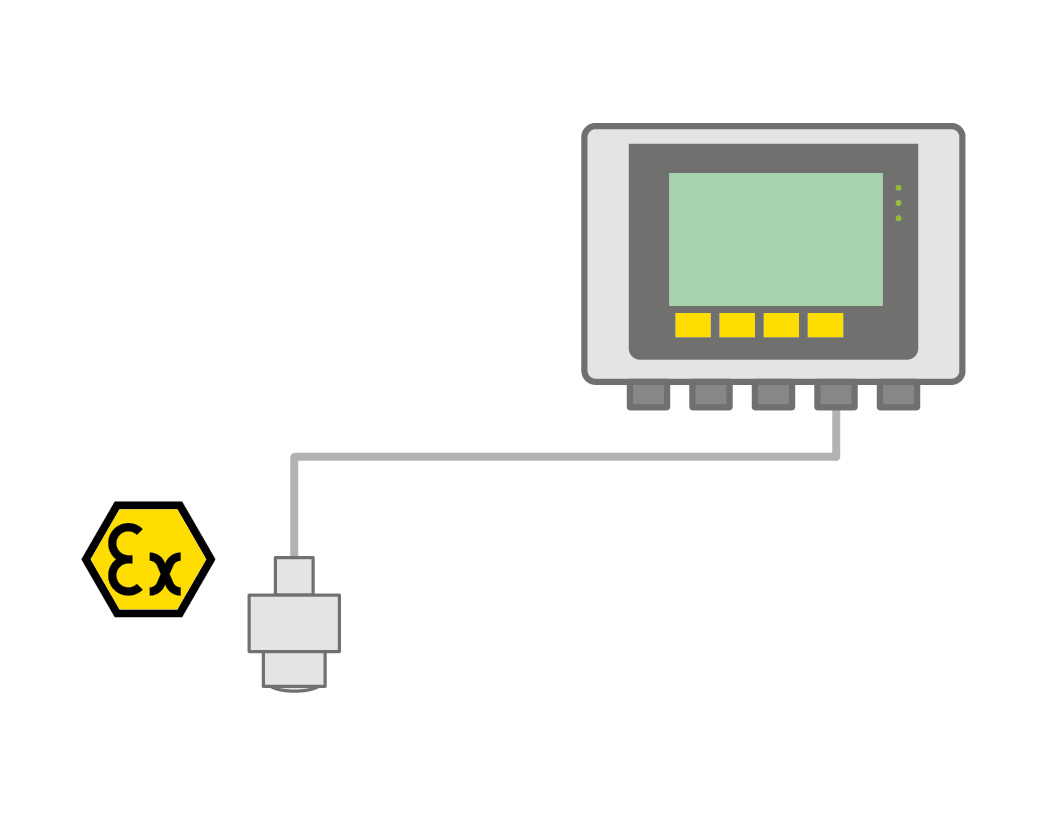

Zuverlässige Messtechnik für die Desinfektion

Sauberes Trinkwasser

In Anbetracht aktueller Herausforderungen wie Klimawandel und Wasserknappheit, auch in Europa, wird eine sichere Aufbereitung und Verteilung des Trinkwassers immer wichtiger. So verlangt die Gesetzgebung immer mehr Wasseranalysen…

-

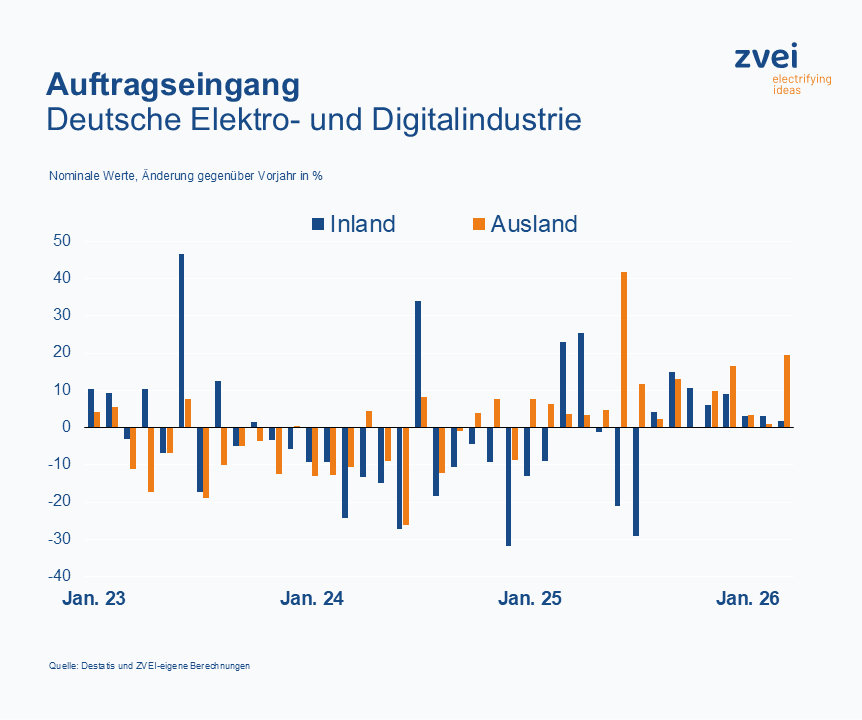

Elektro- und Digitalindustrie mit deutlichem Auftragsplus im Frühjahr

Die Auftragseingänge in der deutschen Elektro- und Digitalindustrie sind im März zweistellig gestiegen, und zwar um 11,5% gegenüber Vorjahr.

-

Anzeige

Vorsprung im Packaging

Automatisierungstechnik von Beckhoff ermöglicht die effiziente Entwicklung ressourcenschonender Verpackungsmaschinen, verkürzt Konstruktionszeiten und senkt…

-

Die Stärken von Laser-Distanz- und Time-of-Flight-Sensoren mit Anwendungsbeispielen

Wann sind optische Distanzsensoren die bessere Wahl?

Präzise Distanzmessung ist ein entscheidender Faktor für zuverlässige Prozessabläufe und Qualitätssicherung, von der…

-

Edge-IoT Lösungen ohne großen Aufwand implementieren

Maschinendaten mit KI effektiv analysieren

Mit Coligo will Be.services eine Brücke zwischen Automatisierung und Datenanalyse schlagen. Die No-Code-Edge-AIoT-Plattform…

-

Industrielle KI und Datenökosysteme

Zwei Seiten einer Medaille

Allein hochproduktive und zuverlässige Maschinen, Anlagen oder Komponenten zu liefern oder zu betreiben,…

-

Importpreise im März: +2,3% gegenüber März 2025

Die Importpreise waren im März 2026 um 2,3% höher als im März 2025.

-

Verbesserter Ultraschall-Durchflusswandler

Der UFC23 erweitert das Portfolio der ScioSense-Ultraschall-Durchflussmessgeräte um eine reine Front-End-Architektur, bei der…

-

Kleinantriebe für hochdynamische Achsen und präzise Bewegungen

Erweiterung und Upgrade

Wittenstein Cyber Motor erweitert innerhalb seines industriegerechten Kleinservoantriebssystems die Servomotoren der Baureihe Cyber…

-

Safety Engineering mit Integration der Verwaltungsschale

Funktionale Sicherheit durch physikalische Simulation

Im modernen Maschinen- und Anlagenbau ist die funktionale Sicherheit einer der wichtigsten Bestandteile.…

-

Neuheiten Sens

Kontinuierliche Taupunktmessung bis -70°C

Mit dem TDS501 stellt E+E Elektronik einen Taupunktsensor für anspruchsvolle Industrieanwendungen vor.

-

MVO, CRA und NIS 2

Angriffspunkt Maschine: Warum Cybersecurity im Maschinenbau zur Kernaufgabe wird

Maschinen und Anlagen sind heute Teil eines hochvernetzten digitalen Ökosystems. Produktionsdaten fließen in…

-

Warum Software die funktionale Sicherheit in der Robotik neu definiert

Ende der getrennten Welten

Auch wenn kollaborierende Robotik als Treiber der Automatisierung gilt, wächst der Aufwand für…

-

Schneider Electric: Neue Leitung Serviceorganisation DACH

Schneider Electric hat Anika Heinen zum 1. Mai zur Vice President Service DACH…

-

Phoenix Contact etabliert Position des Chief Sales Officer

Phoenix Contact etabliert neuen Chief Sales Officer zur globalen Ausrichtung des Vertriebs. Stephan…

-

ABB steigert Umsatzum 18% in Q1

Dank eines allgemein günstigen Marktumfelds und einer verbesserten Geschäftsperformance ist ABB stark ins…

-

Kompaktes Sicherheitsrelais

Mit dem Sicherheitsrelais PSRcompact baut Phoenix Contact sein Portfolio an Sicherheitsschaltgeräten weiter aus.

-

Sicherheitslösungen für die Intralogistik

Bei den Sicherheitslösungen von Sick für reibungslosen Materialtransporte durch stationäre und mobile Fördertechnik…

-

Cybersecurity an der Edge

Wie sichere Edge-Plattformen Schwachstellen in vernetzten Produktionsanlagen schließen

Vernetzung ist aus der modernen Produktion nicht mehr wegzudenken – ohne Sensoren, Anlagen…

-

Miniatur-Encoder jetzt in Schutzart IP65

Der Miniatur-Encoder BGE16wd von EBE arbeitet aufgrund seiner Gleitlagerung und Hall-sensorischen Umdrehungserfassung verschleißfrei…

-

Hybride Steckverbinderlösung für Machine-Vision-Systeme

Rosenberger erweitert sein Portfolio um HySpeedVision, eine hybride Steckverbinderlösung für Machine-Vision-Systeme in Automatisierung…

-

IP-Schutz und Lizenzierung in ressourcenarmen Embedded-Umgebungen

Wenn der Mikrocontroller zur Schwachstelle wird

Firmware auf Microcontroller-basierten Geräten ist oft unzureichend geschützt – zu wenig Speicher, komplexes…

das könnte sie auch interessieren

-

-

-

Offenes Ecosystem wird zur Basis für KI mit Mehrwert

Offenheit als Treiber für die flexible Produktion

-